Critique de Seedance 1.5 Pro : Le chef-d''œuvre audiovisuel de ByteDance avec un Lip-Sync parfait

Si 2025 s'est terminé avec la révolution open source de LTX-2, 2026 commence par une démonstration de puissance industrielle brute. Seedance 1.5 Pro, le dernier modèle de fondation de ByteDance (l'équipe derrière TikTok/Doubao), est officiellement entré dans l'arène.

Comme LTX-2, il propose une Génération Audiovisuelle Conjointe Native — créant son et vidéo en une seule passe. Mais Seedance 1.5 Pro va plus loin. Il vise le "Saint Graal" de la vidéo IA : le dialogue des personnages et la cohérence narrative.

Bien que vous ne puissiez pas (encore) faire tourner cela sur votre RTX 4090 locale, ses capacités via l'API Volcano Engine remodèlent la façon dont les publicités commerciales et les courts métrages sont réalisés. Dans cette critique, nous analysons le papier arxiv Seedance 1.5 (2512.13507) et le comparons directement avec son rival open source, LTX-2.

Sous le capot : L'architecture DiT "Double Branche"

Contrairement aux modèles vidéo traditionnels qui traitent l'audio comme une réflexion après coup, Seedance 1.5 Pro est construit sur un Diffusion Transformer (DiT) à Double Branche.

- Branche Visuelle : Gère la génération de pixels, la dynamique de mouvement et l'éclairage.

- Branche Audio : Génère les formes d'onde, l'ambiance de fond et le dialogue.

- La Magie : Un "Module Conjoint Cross-Modal" relie ces deux branches à chaque étape du processus de diffusion.

Pourquoi c'est important : Lorsqu'un personnage dans Seedance 1.5 Pro parle, le modèle ne se contente pas de "faire correspondre" les mouvements des lèvres à une piste préenregistrée. Il génère la forme de la bouche et le son du phonème simultanément. Cela se traduit par une performance de lip-sync Seedance 1.5 qui rivalise avec l'animation manuelle.

Fonctionnalité Tueur 1 : Lip-Sync de Précision & Dialectes

C'est là que Seedance 1.5 Pro vs LTX-2 devient un combat unilatéral. Alors que LTX-2 est excellent pour les sons atmosphériques (explosions, pluie), Seedance excelle dans la performance humaine.

- Support Multilingue : Support natif pour le mandarin, l'anglais, le japonais et le coréen.

- Maîtrise des Dialectes : Étonnamment, le modèle supporte des dialectes chinois spécifiques (comme le sichuanais ou le cantonais), préservant la cadence culturelle du discours.

- Cas d'Usage : Idéal pour les courts métrages IA (短剧) et les publicités e-commerce mondiales où le doublage brise généralement l'immersion.

Note : Le modèle peut générer un personnage jouant les répliques d'un script texte avec une synchronisation parfaite, une fonctionnalité maintenant entièrement disponible sur notre plateforme.

Fonctionnalité Tueur 2 : Contrôle de Caméra Cinématographique

Le contrôle de mouvement a toujours été une faiblesse de la vidéo générative. Seedance 1.5 Pro introduit une "Interface de Contrôle de Caméra" qui comprend la terminologie cinématographique.

Vous pouvez explicitement prompter des mouvements de caméra complexes :

- "Hitchcock Zoom" (Travelling contrarié) : L'arrière-plan se compresse tandis que le sujet reste stationnaire.

- "Long Take Tracking" (Plan-séquence) : Suivre un sujet pendant plus de 10 secondes sans déformation.

- "Whip Pan" (Panoramique filé) : Transition rapide entre deux sujets.

Pour les créateurs, cela signifie que le contrôle de mouvement de Seedance 1.5 n'est pas juste de la chance aléatoire — c'est un outil dirigeable.

Comparaison : Seedance 1.5 Pro vs LTX-2

| Fonctionnalité | Seedance 1.5 Pro (ByteDance) | LTX-2 (Lightricks) |

|---|---|---|

| Architecture | DiT Double Branche (Fermé) | DiT Flux Unique (Ouvert) |

| Accès | API Volcano Engine | Local / ComfyUI |

| Lip-Sync | Parfait (Focus Dialogue) | Basique (Focus Effets Sonores) |

| Mouvement | Complexe (Contrôle Caméra) | Rapide & Fluide |

| Coût | Par Token / Appel API | Gratuit (Dépend du Matériel) |

| Meilleur Pour | Storytelling & Pubs | Clips Musicaux & Réseaux Sociaux |

Intégration : Comment accéder à Seedance 1.5 Pro

Puisque Seedance est un modèle basé sur API, vous ne pouvez généralement pas charger de .safetensors localement comme LTX-2.

Le défi avec ComfyUI local

Bien que certains wrappers ComfyUI Seedance 1.5 existent, ils nécessitent que vous demandiez un compte entreprise spécialisé auprès du Volcano Engine de ByteDance et que vous gériez des clés API complexes et la facturation.

La solution : Utilisez notre intégration

Nous avons intégré l'API Seedance 1.5 Pro directement dans notre site web, la rendant accessible à tous sans obstacles d'entreprise.

- Pas besoin de clés API : Nous gérons la connexion backend.

- Accès instantané : Utilisez les fonctionnalités Lip-Sync et Contrôle Caméra via notre interface utilisateur simple.

- Rentable : Générez des vidéos sans gérer l'infrastructure cloud.

Essayez Seedance 1.5 Pro en ligne (Commencez à créer des vidéos IA professionnelles).

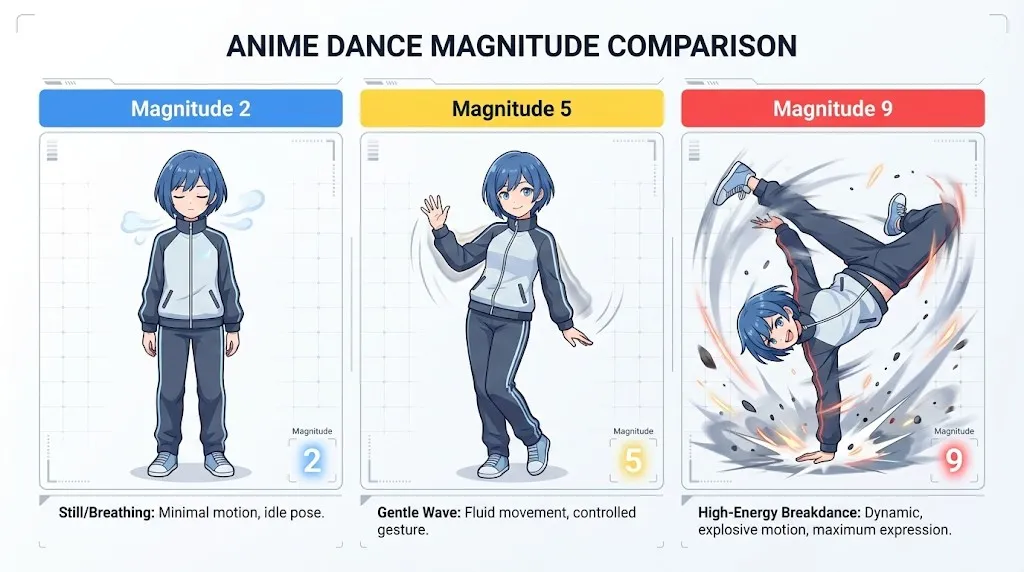

Le Paramètre "Motion Magnitude"

Un détail technique du papier arxiv Seedance 1.5 qui mérite d'être noté est le contrôle de "Motion Magnitude" (Amplitude de Mouvement).

- Bas (1-3) : Mouvements subtils, micro-expressions (génial pour les interviews).

- Haut (7-10) : Action exagérée style anime ou mouvements de danse.

Si vous utilisez Seedance 1.5 pour la génération de danse, montez ce paramètre à 8 pour vous assurer que les membres bougent de manière fluide sans "s'effondrer" dans le torse.

Conclusion

Seedance 1.5 Pro est "l'Adulte dans la Pièce" pour la vidéo IA. Alors que les modèles open source comme LTX-2 sont amusants et accessibles, Seedance offre la cohérence et le contrôle requis pour les pipelines de production professionnels.

Si votre projet implique des personnages qui parlent, des mouvements de caméra narratifs complexes, ou nécessite une adhésion stricte à un script, Seedance 1.5 Pro est actuellement sans rival. Il prouve que l'avenir de la vidéo IA ne concerne pas seulement les pixels — il s'agit du mariage sans couture du Son et de la Vision.

Critique de LTX-2 (LTX Video) : Le premier modèle "Audio-Visuel" Open Source

Lightricks LTX-2 révolutionne la vidéo IA : 4K natif, 50 FPS, audio synchronisé, et tourne sur 16 Go de VRAM avec FP8. Essayez-le en ligne ou consultez le guide ComfyUI.

Kling 3 4K vs Pro (1080p) : quand le 4K vaut le coup (et quand ce n'est pas le cas)

Cadre de décision pratique pour choisir Kling 3 4K vs Pro (1080p) : quand le 4K ameliore detail, mouvement et compression, et quand le 1080p est le bon choix.

Kling 3 4K workflow : prompts, preparation des plans, et export qui tiennent vraiment

Kling 3 4K workflow reproductible : itération en deux passes, templates de prompt, regles de complexite, et export pour survivre a la recompression.

Kling 3 native 4K : ce que cela change pour la qualité, le mouvement, la compression et l'usage réel

Comprendre ce que Kling 3 native 4K change face au 1080p : details plus nets, mouvement plus propre, moins d'artefacts, et quand le 4K vaut vraiment le coup.

HappyHorse AI Video Generator : ce que peut faire ce nouveau modèle

Découvrez HappyHorse, un nouveau modèle de génération vidéo avec text-to-video, image-to-video, video-to-video, audio natif et des workflows pensés pour les créateurs.

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

Découvrez comment les capacités avancées d'édition et de rendu de texte 3K du nouveau modèle Wan 2.7 Image créent le pipeline d'actifs parfait pour la génération de vidéos Kling 2.6.

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.

Maîtriser la Synchronisation Audio-Visuelle : Mon Guide Pratique de Kling Video 3.0 Omni

Un guide complet sur les capacités audio-vidéo natives de Kling Video 3.0 Omni. Apprenez à obtenir des mouvements de bouche IA précis, une synchronisation labiale parfaite et une reproduction d'émotions complexes pour du contenu vidéo IA professionnel.