The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The landscape of digital content creation is preparing for a monumental shift this March.

For creators who felt restricted by early AI limitations, the highly anticipated Wan 2.7 Video release marks a turning point. It is no longer just about generating random clips; it is about building a professional, controllable ecosystem. By seamlessly blending the features of the upcoming release with the lessons learned from previous versions, the Wan ai 2.7 system is redefining how we approach digital storytelling.

Overcoming the Limits of 2.6

If you used the 2.6 version, you likely encountered the "blind box" dilemma—typing a prompt and hoping the AI wouldn't distort your character's face or violate the laws of physics.

The Wan 2.7 ai Video engine completely abandons pure text-guessing. Instead of relying solely on the old Wan 2.7 text to video framework, it introduces a multi-modal injection system. You can now use images to lock in art styles or audio to dictate the rhythm, making the Wan 2.7 image to video capability incredibly precise.

Furthermore, the frustrating 15-second fragment limit is gone. Through the innovative Wan2.7 continue filming technology, the engine can logically extend your existing footage, generating infinite long-take sequences that strictly follow narrative logic.

The New Four-Stage Professional Workflow

Adopting the wanai2.7 platform means upgrading to a studio-grade workflow:

- Pre-Production Precision: You can strictly define your opening and closing shots using First & Last Frame Control, ensuring your storyboard is executed perfectly.

- Dynamic Production: Need to animate a comic? The 9-grid image transformation turns static panels into fluid motion.

- Surgical Editing: Unlike basic style transfers, Wan2.7 allows for instruction-based directed editing. Using specific @tags, you can replace elements or characters without disrupting the original lighting or camera trajectory.

- Audio-Visual Mastery: The Wan 2.7 ai video generator aligns lip movements to dialogue with millisecond accuracy and synchronizes physical actions to music beats.

Best of all, commercial safety is guaranteed. Paid users retain 100% ownership of their generated content, making the Wanai 2.7 Video tool entirely safe for client delivery.

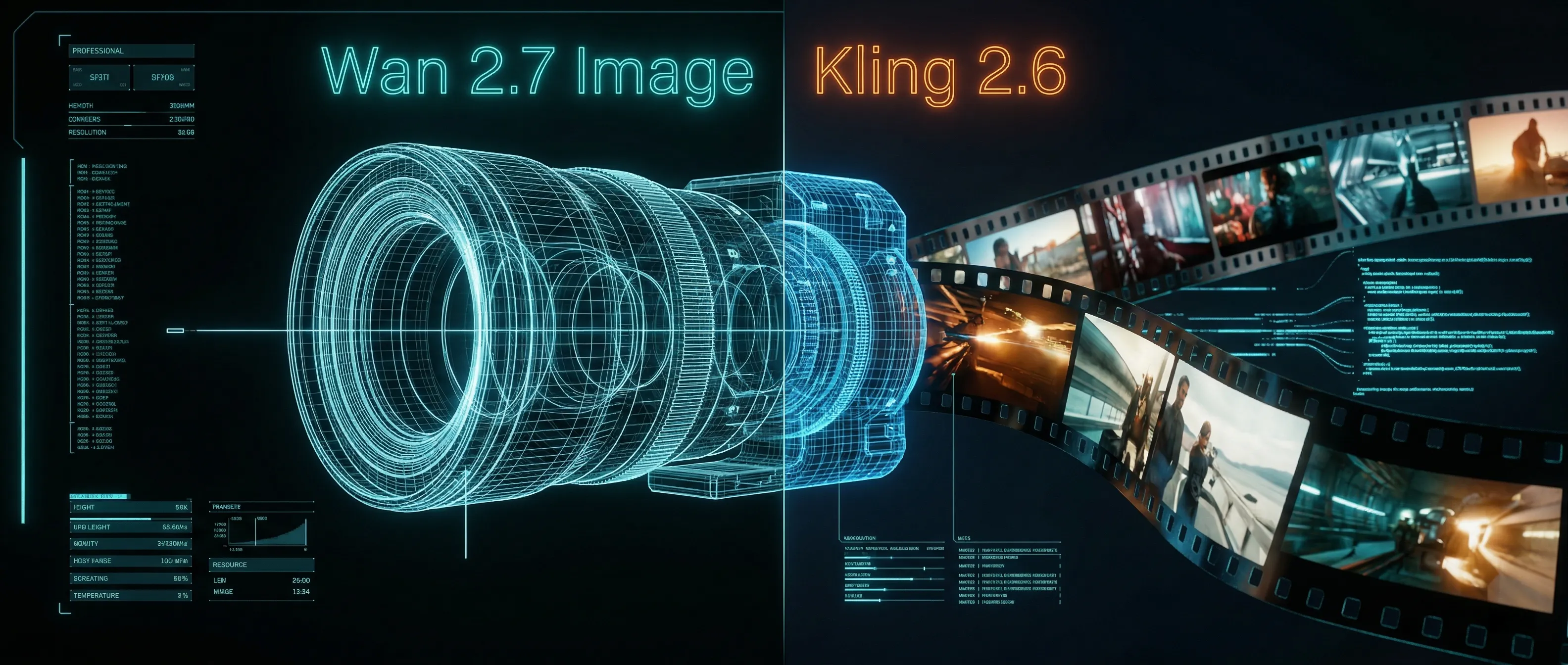

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

Découvrez comment les capacités avancées d'édition et de rendu de texte 3K du nouveau modèle Wan 2.7 Image créent le pipeline d'actifs parfait pour la génération de vidéos Kling 2.6.

Guide Z-Image Turbo : Faire tourner le monstre 6B d''Alibaba dans ComfyUI (Vs. FLUX)

Oubliez les 24 Go de VRAM. Le Z-Image Turbo (6B) d''Alibaba offre des résultats photoréalistes et un rendu de texte chinois parfait en seulement 8 étapes. Voici votre guide complet du workflow ComfyUI.

Maîtriser Kling Motion Control : Le guide ultime de la marionnette numérique par IA (2026)

Une plongée en profondeur dans Kling Motion Control. Apprenez à utiliser les modes d'orientation des personnages, à corriger les erreurs et à maîtriser le flux de travail pour des vidéos IA cinématographiques.

Kling 3 4K vs Pro (1080p) : quand le 4K vaut le coup (et quand ce n'est pas le cas)

Cadre de décision pratique pour choisir Kling 3 4K vs Pro (1080p) : quand le 4K ameliore detail, mouvement et compression, et quand le 1080p est le bon choix.

Kling 3 4K workflow : prompts, preparation des plans, et export qui tiennent vraiment

Kling 3 4K workflow reproductible : itération en deux passes, templates de prompt, regles de complexite, et export pour survivre a la recompression.

Kling 3 native 4K : ce que cela change pour la qualité, le mouvement, la compression et l'usage réel

Comprendre ce que Kling 3 native 4K change face au 1080p : details plus nets, mouvement plus propre, moins d'artefacts, et quand le 4K vaut vraiment le coup.

HappyHorse AI Video Generator : ce que peut faire ce nouveau modèle

Découvrez HappyHorse, un nouveau modèle de génération vidéo avec text-to-video, image-to-video, video-to-video, audio natif et des workflows pensés pour les créateurs.

Maîtriser la Synchronisation Audio-Visuelle : Mon Guide Pratique de Kling Video 3.0 Omni

Un guide complet sur les capacités audio-vidéo natives de Kling Video 3.0 Omni. Apprenez à obtenir des mouvements de bouche IA précis, une synchronisation labiale parfaite et une reproduction d'émotions complexes pour du contenu vidéo IA professionnel.