Maîtriser Kling Motion Control : Le guide ultime de la marionnette numérique par IA (2026)

[!NOTE] Ce guide est basé sur la documentation officielle de Kling AI Motion Control en date de janvier 2026.

Maîtriser Kling Motion Control : Le guide ultime de la marionnette numérique par IA (2026)

Dans le paysage en évolution rapide de la génération de vidéos par IA, Kling Motion Control représente un changement de paradigme, passant de la génération stochastique au contrôle déterministe. Cette technologie transforme la façon dont les créateurs abordent la « marionnette numérique » (Digital Puppetry), offrant une précision sans précédent dans l'animation des personnages et la réplication des mouvements. Contrairement aux outils vidéo IA traditionnels qui reposent sur le hasard, Kling Motion Control fournit un cadre systématique pour obtenir des résultats cohérents et de haute qualité.

Motion Control vs. Motion Brush : Comprendre la différence

La distinction entre les technologies Kling Motion Control et Motion Brush est fondamentale pour comprendre leurs applications respectives.

Motion Control fonctionne sur une approche pilotée par le squelette (skeleton-driven), où l'IA analyse la structure osseuse sous-jacente et les mouvements articulaires à partir des images de référence. Cette méthode excelle dans la réplication d'actions physiques complexes avec une précision anatomique.

En revanche, les outils Motion Brush suivent des modèles pilotés par la trajectoire (trajectory-driven), se concentrant sur le chemin du mouvement plutôt que sur la mécanique structurelle. Bien qu'efficaces pour des animations simples, ils manquent de la précision requise pour une réplication réaliste du mouvement humain.

La capacité du système Kling Motion Control à comprendre la biomécanique le rend particulièrement précieux pour les applications nécessitant des modèles de mouvement naturels.

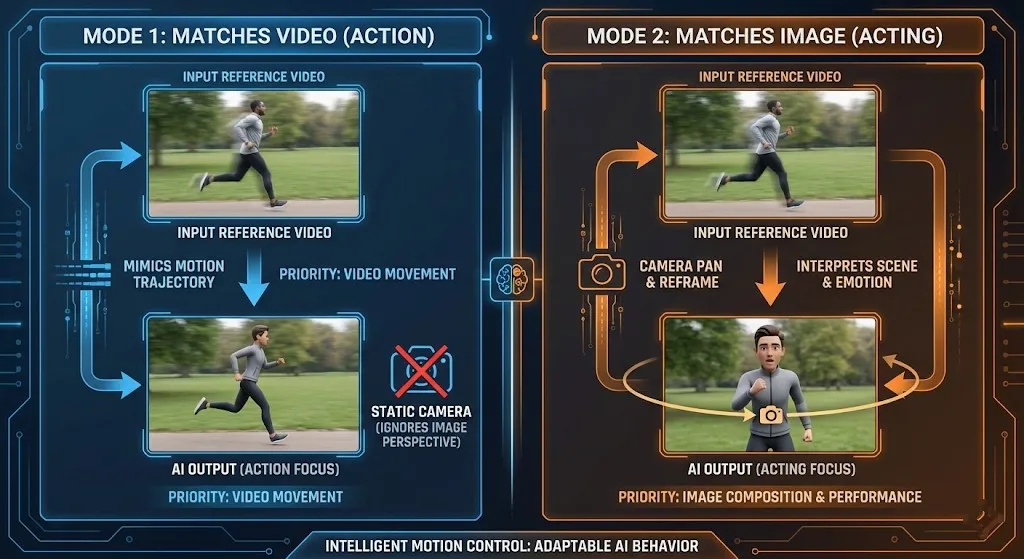

Analyse approfondie : Les deux modes d'orientation des personnages

Mode 1 : Character Orientation Matches Video (Idéal pour l'action corporelle complète, le sport)

Ce mode par défaut donne la priorité au maintien de la relation spatiale entre le personnage et son environnement, telle qu'elle apparaît dans la vidéo de référence.

Lorsque vous sélectionnez Character Orientation Matches Video, l'IA préserve la perspective originale de la caméra et le positionnement du personnage par rapport à l'arrière-plan. Cette approche est idéale pour :

- Les séquences sportives où le maintien de l'orientation sur le terrain est crucial

- Les spectacles de danse nécessitant un positionnement scénique cohérent

- Les scènes d'action avec des interactions environnementales complexes

- Les activités de groupe où les relations spatiales sont importantes

Le système analyse les angles de caméra et le placement des personnages de la vidéo de référence, puis applique ces contraintes spatiales à votre contenu généré. Cela garantit que les mouvements restent contextuellement appropriés au sein de leur environnement virtuel.

Mode 2 : Character Orientation Matches Image (Idéal pour le jeu d'acteur, les mouvements de caméra)

Lorsque vous choisissez Character Orientation Matches Image, le système donne la priorité à la pose et à l'orientation d'origine de votre personnage à partir de l'image d'entrée. Ce mode permet un travail de caméra plus créatif tout en maintenant la cohérence du personnage.

Les applications clés incluent :

- Les performances dramatiques nécessitant une cohérence émotionnelle

- Les plans rapprochés (Close-up shots) où les expressions faciales sont primordiales

- Les séquences de mouvement de caméra (panoramiques, inclinaisons, zooms)

- Les récits centrés sur le personnage avec des contraintes environnementales minimales

Ce mode découple efficacement l'orientation du personnage de la perspective de la caméra, offrant aux créateurs une plus grande flexibilité dans la narration cinématographique. L'IA se concentre sur la préservation de la pose fondamentale de votre personnage tout en permettant à la caméra virtuelle de se déplacer indépendamment.

Flux de travail étape par étape pour des résultats professionnels

Préparation : Spécifications d'entrée

La mise en œuvre réussie de Kling Motion Control commence par une préparation appropriée des entrées. Suivez ces directives pour des résultats optimaux :

Exigences pour la vidéo de référence :

- Durée : 3 à 30 secondes (zone idéale : 5 à 15 secondes)

- Résolution : Minimum 720p, recommandé 1080p ou plus

- Visibilité du sujet : Corps entier dans le cadre, pas d'obstructions

- Qualité du mouvement : Mouvement clair et continu sans coupures ni sauts

- Éclairage : Éclairage cohérent, éviter les ombres extrêmes

Spécifications pour l'image du personnage :

- Clarté : Image haute résolution avec des traits du visage visibles

- Pose : Debout naturel ou pose d'action correspondant au mouvement prévu

- Arrière-plan : Les arrière-plans simples et non encombrés fonctionnent le mieux

- Éclairage : Éclairage uniforme sans ombres dures

Processus : Télécharger la référence → Sélectionner le mode → Prompter l'environnement

- Télécharger la vidéo de référence : Commencez par sélectionner un clip de référence de haute qualité qui démontre le modèle de mouvement que vous souhaitez répliquer. Assurez-vous que le sujet est clairement visible et que le mouvement est continu.

- Choisir le mode d'orientation : En fonction de vos objectifs créatifs, sélectionnez soit Character Orientation Matches Video pour la cohérence environnementale, soit Character Orientation Matches Image pour une narration centrée sur le personnage.

- Rédiger les prompts d'environnement : Décrivez le cadre souhaité en utilisant un langage spécifique et évocateur.

- Exemple : "A futuristic cityscape at dusk with neon lights reflecting on wet streets" (Un paysage urbain futuriste au crépuscule avec des néons se reflétant sur les rues humides).

- Vérifier et générer : Prévisualisez vos paramètres, puis lancez le processus de génération. L'IA analysera vos entrées et créera la séquence contrôlée par le mouvement.

Contrôle avancé de la caméra via les Prompts

Puisque le mode Character Orientation Matches Image prend en charge les mouvements de caméra indépendants, vous pouvez obtenir des effets cinématographiques sophistiqués grâce à des prompts stratégiques :

Plans panoramiques (Pan Shots)

Créez des mouvements de caméra horizontaux avec des prompts comme :

- "Slow pan from left to right revealing the expansive landscape" (Panoramique lent de gauche à droite révélant le vaste paysage)

- "Quick pan following the character's movement across the room" (Panoramique rapide suivant le mouvement du personnage à travers la pièce)

- "Gentle pan establishing the environment before focusing on the subject" (Panoramique doux établissant l'environnement avant de se concentrer sur le sujet)

Mouvements d'inclinaison (Tilt Movements)

Implémentez des angles de caméra verticaux avec des descriptions telles que :

- "Low-angle tilt upward emphasizing the character's stature" (Contre-plongée vers le haut soulignant la stature du personnage)

- "High-angle tilt downward creating a sense of vulnerability" (Plongée vers le bas créant un sentiment de vulnérabilité)

- "Dutch tilt for dramatic, disorienting effect" (Plan débullé pour un effet dramatique et désorientant)

Effets de Zoom

Contrôlez les changements de distance focale avec des prompts comme :

- "Slow zoom-in on the character's expressive face" (Zoom avant lent sur le visage expressif du personnage)

- "Crash zoom for sudden dramatic emphasis" (Zoom brutal pour une emphase dramatique soudaine)

- "Dolly zoom creating vertigo effect" (Travelling contrarié créant un effet de vertige)

Techniques de trépied (Tripod)

Pour des plans stables et professionnels :

- "Static tripod shot with subtle camera breathing" (Plan fixe sur trépied avec une légère respiration de la caméra)

- "Locked-off camera position with character movement" (Position de caméra verrouillée avec mouvement du personnage)

- "Steadicam-style smooth following shot" (Plan de suivi fluide style Steadicam)

Le coût « caché » de la perfection

Bien que le coût unitaire soit accessible, atteindre une qualité de diffusion avec Kling Motion Control nécessite souvent une mentalité « Gacha ». Attendez-vous à générer 3 à 5 variations pour obtenir un alignement parfait des membres et éliminer les artefacts.

Les défis courants incluent :

Hallucinations des membres (Limb Hallucinations)

L'IA peut occasionnellement générer des membres supplémentaires ou des positions articulaires incorrectes. Cela se produit généralement lorsque :

- Le mouvement de référence contient des chevauchements complexes

- Les vêtements du personnage créent des silhouettes ambiguës

- Les conditions d'éclairage obscurcissent la définition claire du corps

Problèmes de cohérence temporelle

Maintenir une apparence cohérente du personnage tout au long de la séquence peut être difficile, en particulier avec :

- Des séquences de mouvements rapides

- Une dynamique complexe des tissus

- Des conditions d'éclairage changeantes

Intégration environnementale

Intégrer harmonieusement des personnages dans de nouveaux environnements nécessite une ingénierie de prompt minutieuse et plusieurs itérations pour obtenir des interactions d'apparence naturelle.

Dépannage : Codes d'erreur courants

"Upper Body Not Detected" (Haut du corps non détecté)

Cette erreur se produit lorsque l'IA ne peut pas identifier clairement la structure du haut du corps du sujet.

Les causes courantes incluent :

- Sujet trop petit : Assurez-vous que votre personnage occupe suffisamment d'espace dans le cadre (recommandé : 60-80 % de la hauteur du cadre).

- Vues obstruées : Retirez tout objet bloquant le haut du corps du personnage.

- Mauvais éclairage : Améliorez l'éclairage pour renforcer la définition du corps.

- Arrière-plans complexes : Utilisez des arrière-plans plus simples pour une meilleure détection.

Solution : Relfilmez la séquence de référence avec une meilleure visibilité du sujet et de meilleures conditions d'éclairage.

Dérive de la caméra (Camera Drift)

Lors de l'utilisation du mode Character Orientation Matches Image, une dérive de la caméra peut se produire si les prompts manquent d'indices de stabilité :

- Problème : Mouvement de caméra involontaire ou images tremblantes.

- Causes : Descriptions de mouvement ambiguës, instructions de caméra contradictoires, manque de prompts de stabilisation.

- Correction : Incluez un langage de stabilisation explicite dans vos prompts :

- "Stable camera position with no movement" (Position de caméra stable sans mouvement)

- "Locked-off shot on a tripod" (Plan verrouillé sur trépied)

- "Steady camera following smooth motion" (Caméra stable suivant un mouvement fluide)

Meilleures pratiques pour des résultats optimaux

Sélection de la vidéo de référence

Choisissez une séquence de référence qui correspond à la complexité de sortie prévue.

- Pour les débutants :

- Commencez par des mouvements simples de marche ou debout.

- Passez à des actions plus complexes à mesure que vous gagnez de l'expérience.

- Évitez initialement les clips de référence avec des mouvements de caméra rapides.

Ingénierie de Prompt

Développez une approche systématique de la création de prompts :

- Commencez par la description de l'environnement

- Ajoutez les détails de l'action du personnage

- Spécifiez le comportement de la caméra

- Incluez l'ambiance et les éléments d'éclairage

Raffinement itératif

Adoptez la nature itérative de la génération vidéo par IA :

- Générez plusieurs variations avec de légers ajustements de prompt

- Analysez chaque résultat pour identifier les domaines d'amélioration spécifiques

- Construisez une bibliothèque de combinaisons de prompts réussies

Applications dans le monde réel

Production de films et d'animation

Kling Motion Control révolutionne les pipelines de prévisualisation et d'animation en :

- Réduisant le temps d'animation des personnages de plusieurs semaines à quelques heures

- Permettant une itération rapide sur les concepts de mouvement

- Fournissant une référence de mouvement réaliste pour les animateurs traditionnels

Développement de jeux

Les studios de jeux exploitent cette technologie pour :

- Le prototypage rapide d'animations de personnages

- La création de bibliothèques de mouvements de PNJ diversifiées

- La génération efficace de cinématiques (cutscenes)

Contenu éducatif

Les éducateurs utilisent le contrôle de mouvement pour :

- Démontrer des concepts physiques complexes

- Créer des reconstitutions historiques engageantes

- Produire du matériel d'apprentissage interactif

Développements futurs

À mesure que la technologie Kling Motion Control évolue, attendez-vous à des avancées dans :

- Les interactions multi-personnages avec des dynamiques sociales complexes

- La simulation physique améliorée pour des interactions environnementales plus réalistes

- Les interfaces de contrôle en temps réel pour les applications de performance en direct

- La compatibilité multiplateforme avec les principaux logiciels d'animation

Conclusion : Maîtriser l'art de la marionnette numérique

Kling Motion Control représente un bond en avant significatif dans la technologie d'animation pilotée par l'IA. En comprenant les nuances entre les modes Character Orientation Matches Video et Character Orientation Matches Image, les créateurs peuvent obtenir un contrôle sans précédent sur leurs personnages numériques.

La clé du succès réside dans une préparation méticuleuse, une ingénierie de prompt stratégique et l'acceptation de la nature itérative de la génération par IA. Bien qu'atteindre la perfection puisse nécessiter plusieurs tentatives, les résultats — une animation de personnage de qualité cinématographique avec un mouvement réaliste — en valent largement la peine.

Alors que vous poursuivez votre voyage avec Kling Motion Control, n'oubliez pas que chaque génération offre de précieuses opportunités d'apprentissage. Documentez vos approches réussies, analysez vos défis et développez progressivement votre expertise dans cette nouvelle frontière passionnante de la création de contenu numérique.

Prêt à transformer votre flux de travail créatif ? Commencez à expérimenter Kling Motion Control dès aujourd'hui et découvrez la puissance de l'animation IA déterministe.

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

Découvrez comment les capacités avancées d'édition et de rendu de texte 3K du nouveau modèle Wan 2.7 Image créent le pipeline d'actifs parfait pour la génération de vidéos Kling 2.6.

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.

Guide Z-Image Turbo : Faire tourner le monstre 6B d''Alibaba dans ComfyUI (Vs. FLUX)

Oubliez les 24 Go de VRAM. Le Z-Image Turbo (6B) d''Alibaba offre des résultats photoréalistes et un rendu de texte chinois parfait en seulement 8 étapes. Voici votre guide complet du workflow ComfyUI.

Veo 4 vs Seedance 2.1 : pourquoi la prochaine guerre de la vidéo IA pourrait porter davantage sur le coût que sur le rendu cinéma

Seedance 2.1, Veo 4 et Gemini Omni Flash montrent un changement clair : en vidéo IA, le vrai sujet devient le coût d'un output stable et exploitable.

Seedance 2.1 pourrait arriver bientôt : gain de qualité rapporté de 20%, tier moins cher et points à surveiller pour les créateurs

Seedance 2.1 serait proche du lancement, avec un gain rapporté de 20% et un tier Seedance 2.0 moins cher. Voici ce qui semble connu et non confirmé.

Kling 3.0 Stadium Fan Cam : prompts pour un rendu de vraie diffusion TV

Guide pratique Kling 3.0 stadium fan cam : checklist de broadcast realism, prompt de base, correctifs et comparaison placeholder.

Gemini Omni model : ce que c'est (et comment construire sans risque tant que c'est flou)

Guide pratique sur Gemini Omni model : distinguer rumeur et contrat, utiliser Veo 3.1 aujourd'hui, et preparer un router pour activer Gemini Omni API plus tard.

Kling 3 4K cost routing: Ultra vs Pro vs Standard (quand payer la 4K)

Regles simples de Kling 3 4K cost: explorer en 1080p, passer en 4K/Ultra au moment du livrable, et eviter de bruler des credits.