Das Ende des Nvidia-Monopols: Wie GLM-Image und Huawei Ascend die globalen AI-Charts eroberten

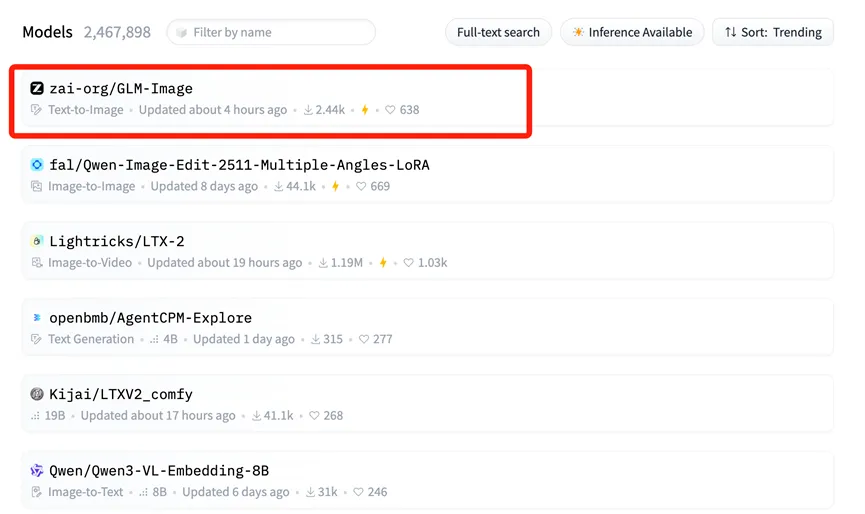

Am 14. Januar ereignete sich eine seismische Verschiebung in der globalen KI-Landschaft, die sowohl Industriegenies als auch die Kapitalmärkte weltweit aufhorchen ließ. GLM-Image, ein multimodales Bildgenerierungsmodell, das gemeinsam von Zhipu AI und Huawei entwickelt wurde, kletterte auf Platz eins der Hugging Face Trending-Liste.

Für Uneingeweihte: Hugging Face ist im Grunde die „Weltausstellung“ für Open-Source-Modelle – ein zentraler Hub, an dem internationale Giganten und Entwickler ihre besten KI-Tools präsentieren. Die Spitze der Trending-Liste zu erreichen, ist vergleichbar mit dem Hauptauftritt auf der weltweit wichtigsten Tech-Konferenz und signalisiert die internationale Anerkennung der technischen Leistungsfähigkeit und des Anwendungswerts von GLM-Image.

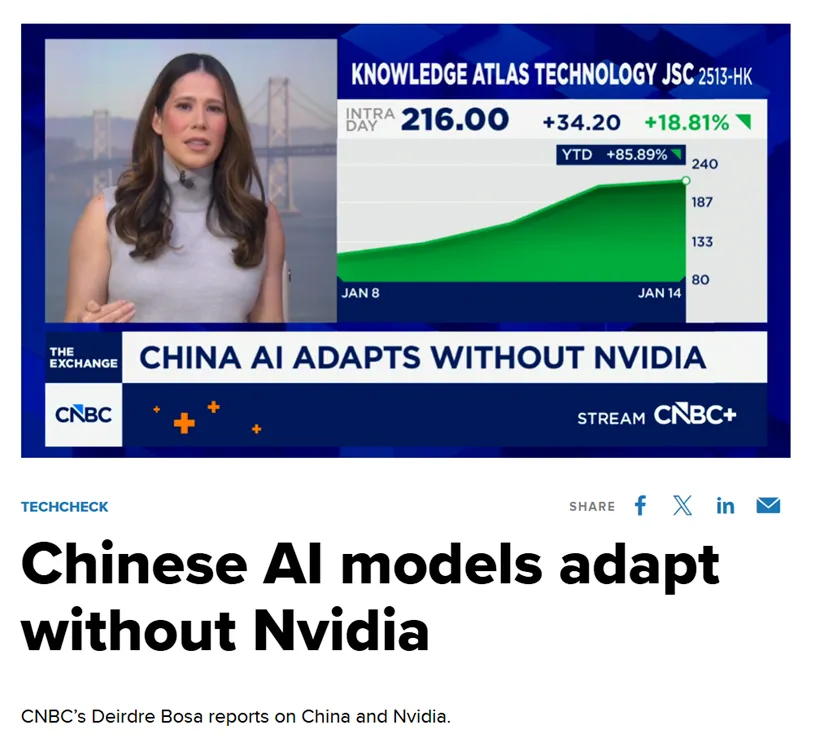

Der US-Nachrichtensender CNBC bemerkte, dass dieses fortschrittliche Modell, trainiert von Zhipu und Huawei, den „Mythos“ der Abhängigkeit von US-Chips wirkungsvoll „bricht“. Dieser Erfolg ist kein Zufall, sondern das unvermeidliche Ergebnis einer tiefen „Software-Hardware-Synergie“ und eines Durchbruchs in der gesamten heimischen KI-Industriekette Chinas.

Das „Full-Stack“-Fundament: Huawei Ascend & MindSpore

Die entscheidende Stütze hinter diesem Erfolg ist das von Huawei aufgebaute Rechenleistungsfundament.

Im Gegensatz zu den meisten früheren KI-Modellen, die für das Training stark auf ausländische GPUs (hauptsächlich Nvidia) angewiesen waren, lief GLM-Image über seinen gesamten Lebenszyklus – von der Datenvorverarbeitung bis zum massiven Training – auf Huawei Ascend 800T A2 Chips und dem MindSpore KI-Framework.

Diese vollständig autonome „Hardware + Framework“-Kombination ist die eigentliche Sensation. Sie löst das zentrale „Nadelöhr“-Problem in der KI-Entwicklung und beweist, dass das Training von State-of-the-Art (SOTA) Modellen auch ohne das CUDA-Ökosystem möglich ist. Die Ascend 910B-Serie (die den 800T A2 antreibt) hat eine beeindruckende Leistung in großen Cluster-Umgebungen gezeigt und bietet der globalen Open-Source-Community eine echte Alternative.

Die Architektur dekonstruiert: Warum AR + Diffusion zählt

Zhipu AI erzielte auch bei der Modellarchitektur bedeutende Innovationen. GLM-Image wich von den technischen Standardrouten ab, die von vielen westlichen Open-Source-Modellen verwendet werden.

Stattdessen nutzt es eine hybride „Autoregressive (AR) + Diffusion Decoder“ Architektur.

- Das „Gehirn“ (Autoregressiv): Ein 9B-Parameter-AR-Modell kümmert sich um das Verständnis komplexer Anweisungen, die Layout-Planung und die Textgenerierung innerhalb von Bildern.

- Der „Maler“ (Diffusion): Ein 7B-Parameter-Diffusionsmodell fungiert als Decoder und füllt basierend auf dem Bauplan des AR-Modells hochauflösende Details ein.

Dieser Ansatz löst ein berüchtigtes Problem bei der KI-Bildgenerierung: die präzise Darstellung von Text. Zuvor enthielten KI-generierte Bilder oft verstümmelten, unleserlichen Text. Dank der starken kognitiven Fähigkeiten der AR-Komponente erzielte GLM-Image die höchste Genauigkeit bei der Generierung chinesischer Schriftzeichen unter allen Open-Source-Modellen.

Dieser technische Pfad – kognitives Verstehen vor der Generierung zu priorisieren – spiegelt den Ansatz wider, der in fortschrittlichen kognitiven Reasoning-Modellen wie Nano Banana Pro zu sehen ist, die sich auf „Wissen + Logik“ konzentrieren, um komplexe Aufgaben präziser zu bewältigen als Standard-Generierungsmodelle.

Marktreaktion: Der Aufstieg von Knowledge Atlas (2513.HK)

Der „Goldstandard“-Wert, die globalen Charts anzuführen, spiegelte sich sofort in den Reaktionen des Kapitalmarktes wider. Als die Nachricht von der Open-Source-Veröffentlichung von GLM-Image bekannt wurde, stieg der Aktienkurs von Zhipu AIs Muttergesellschaft, Knowledge Atlas (2513.HK), an einem einzigen Tag um über 16 %. Investoren erkannten klar den langfristigen Wert der Kombination aus „heimischem Chip + autonomem Modell“.

Tatsächlich ist der Aktienkurs von Knowledge Atlas seit der Notierung an der Hongkonger Börse am 8. Januar als „erste globale Large-Model-Aktie“ um über 100 % gestiegen.

Demokratisierung von AI-Design: Open Source für alle

Langfristig betrachtet wird der Erfolg von GLM-Image durch die Synergie einer ganzen Industriekette vorangetrieben. Diese Full-Chain-Fähigkeit dient nicht nur Tech-Giganten, sondern senkt die Barrieren für kleine und mittlere Unternehmen (KMU) erheblich.

Mit Inferenzkosten von nur 0,1 RMB (ca. 0,01 USD) pro Bild ermöglicht GLM-Image Unternehmen die Nutzung erstklassiger KI-Designtools zu einem Bruchteil der herkömmlichen Kosten.

Heute sind der Quellcode und die Gewichte für GLM-Image synchron auf GitHub und Hugging Face verfügbar. Entwickler weltweit können nun diese „vollständig autonome Lösung“ frei nutzen und damit das traditionelle Narrativ durchbrechen, dass Spitzentraining von Modellen ausschließlich von US-Silizium abhängt.

Warum Seedance 2.0 entfernt wurde? Die Wahrheit hinter dem StormCrew-Video & Kling 3.0s Niederlage

StormCrews Review löste einen Panik-Bann von Seedance 2.0 aus. Erfahren Sie, warum dessen 10-fache Kosteneffizienz und Destillationstechnologie Kling 3.0 vernichten.

Kling 3 Just Dropped: Will Wan 3 Be the Next Big Shock? (The AI Video Arms Race)

Der AI-Video-Krieg heizt sich auf. Da Kling 3 neue Maßstäbe setzt, analysieren wir die Rivalität, die Geschichte der Audio Battles und sagen voraus, was Wan 3 tun muss, um zu überleben.

Kling 3 4K vs Pro (1080p): Wann sich 4K lohnt (und wann nicht)

Ein praktischer Entscheidungsrahmen fuer Kling 3 4K vs Pro (1080p): wann 4K Detail, Motion und Kompression verbessert - und wann 1080p der bessere Default ist.

Kling 3 4K workflow: Prompts, Shot-Planung und Export-Settings, die wirklich halten

Kling 3 4K workflow fuer brauchbare Deliverables: Two-pass Iteration, Prompt-Templates, safe complexity Regeln und Export-Hygiene fuer Plattform-Rekompression.

Kling 3 native 4K: Was sich bei Qualitaet, Bewegung, Kompression und realer Nutzung wirklich aendert

Was Kling 3 native 4K gegenueber 1080p veraendert: schaerfere Details, stabilere Bewegung, weniger Artefakte - und wann 4K wirklich sinnvoll ist.

HappyHorse AI Video Generator: Was das neue Modell kann

Entdecken Sie HappyHorse, ein neues KI-Videomodell mit Text-zu-Video, Bild-zu-Video, Video-zu-Video, nativer Audioausgabe und kreatorfokussierten Workflows.

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

Entdecken Sie, wie die fortschrittlichen Bearbeitungs- und 3K-Text-Rendering-Funktionen des neuen Wan 2.7 Image-Modells die perfekte Asset-Pipeline für die Kling 2.6-Videogenerierung schaffen.

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.