Seedance 1.5 Pro 评测:字节跳动打造的完美口型音视双绝之作

如果说 2025 年以 LTX-2 的开源革命画上句号,那么 2026 年的开篇则是字节跳动(TikTok/豆包背后的团队)展示其工业级实力的时刻。Seedance 1.5 Pro,这一最新的基础模型正式入局。

与 LTX-2 类似,它具备 原生音视联合生成 (Native Audio-Visual Joint Generation) 能力——即一次性生成声音和视频。但 Seedance 1.5 Pro 更进一步,它瞄准了 AI 视频的“圣杯”:角色对白与叙事一致性。

虽然您暂时无法在本地 RTX 4090 上运行它,但通过 火山引擎 (Volcano Engine) API 展现的能力正在重塑商业广告和短剧的制作方式。在本评测中,我们将解析 Seedance 1.5 arxiv 论文 (2512.13507) 并将其与其开源对手 LTX-2 进行直接对比。

技术解密:“双分支” DiT 架构

不同于将音频视为事后补充的传统视频模型,Seedance 1.5 Pro 构建于 双分支扩散 Transformer (Dual-Branch DiT) 之上。

- 视觉分支 (Visual Branch): 处理像素生成、运动动态和光照。

- 音频分支 (Audio Branch): 生成波形、背景氛围音和对白。

- 核心魔法: 一个“跨模态联合模块 (Cross-Modal Joint Module)”在扩散过程的每一步桥接这两个分支。

这为何重要: 当 Seedance 1.5 Pro 中的角色说话时,模型不仅仅是让嘴部运动去“匹配”预录的音轨。它是在同步生成嘴型和音素的声音。这带来了媲美人工动画的 Seedance 1.5 口型同步 (Lip-Sync) 表现。

杀手级功能 1:精准口型与方言支持

这是 Seedance 1.5 Pro vs LTX-2 对决中一边倒的领域。虽然 LTX-2 擅长环境音(爆炸、雨声),但 Seedance 在 人类表演 方面表现卓越。

- 多语言支持: 原生支持普通话、英语、日语和韩语。

- 方言精通: 令人惊讶的是,该模型支持特定的中国方言(如四川话或粤语),保留了语言的文化韵味。

- 应用场景: 非常适合 AI 短剧 和全球电商广告,在这些场景中,糟糕的配音通常会破坏沉浸感。

注: 该模型可以生成角色根据文本剧本进行表演的视频,且口型完美同步。现在您可以在我们的平台上完整体验此功能。

杀手级功能 2:电影级运镜控制

动作控制一直是生成式视频的弱点。Seedance 1.5 Pro 引入了理解电影术语的“相机控制接口”。

您可以明确提示复杂的运镜:

- "Hitchcock Zoom" (希区柯克变焦/推拉变焦): 背景压缩而主体保持静止。

- "Long Take Tracking" (长镜头跟拍): 跟随主体拍摄 10 秒以上而不发生形变。

- "Whip Pan" (甩镜头): 两个主体之间的快速过渡。

对于创作者而言,这意味着 Seedance 1.5 的动作控制 不再是碰运气——它是一个可控的工具。

对比:Seedance 1.5 Pro vs LTX-2

| 特性 | Seedance 1.5 Pro (字节跳动) | LTX-2 (Lightricks) |

|---|---|---|

| 架构 | 双分支 DiT (闭源) | 单流 DiT (开源) |

| 访问方式 | 火山引擎 API | 本地 / ComfyUI |

| 口型同步 | 完美 (侧重对白) | 基础 (侧重音效) |

| 运动控制 | 复杂 (相机控制) | 快速且流畅 |

| 成本 | 按 Token / API 调用计费 | 免费 (取决于硬件) |

| 最佳用途 | 叙事与广告 | 音乐视频与社交媒体 |

集成:如何使用 Seedance 1.5 Pro

由于 Seedance 是基于 API 的模型,您通常无法像 LTX-2 那样在本地加载 .safetensors 文件。

本地 ComfyUI 的挑战

虽然存在一些 Seedance 1.5 ComfyUI 封装器,但它们通常要求您申请字节跳动火山引擎的企业账号,并管理复杂的 API Key 和账单。

解决方案:使用我们的集成版

我们将 Seedance 1.5 Pro API 直接集成到了我们的网站中,让所有人都能越过企业门槛直接使用。

- 无需 API Key: 我们处理后端连接。

- 即时访问: 通过我们简单的 UI 使用口型同步和相机控制功能。

- 更低成本: 生成视频而无需管理云基础设施。

在线试用 Seedance 1.5 Pro (开始创作专业 AI 视频)。

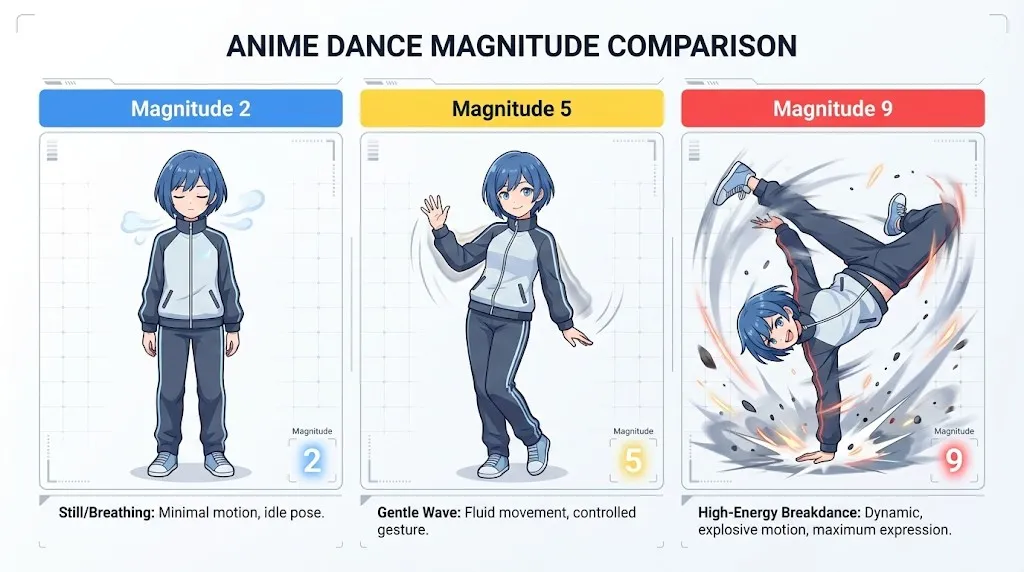

"Motion Magnitude" (运动幅度) 参数

Seedance 1.5 arxiv 论文 中一个值得注意的技术细节是 "Motion Magnitude" 控制。

- 低 (1-3): 微妙的动作,微表情(非常适合采访)。

- 高 (7-10): 夸张的动漫风格动作或舞蹈动作。

如果您使用 Seedance 1.5 生成舞蹈,请将此参数调高至 8,以确保肢体运动流畅,不会“坍缩”进躯干中。

结语

Seedance 1.5 Pro 是 AI 视频领域的“成熟之作”。虽然像 LTX-2 这样的开源模型有趣且易于访问,但 Seedance 提供了专业生产流程所需的 一致性和控制力。

如果您的项目涉及角色说话、复杂的叙事运镜,或需要严格遵循剧本,Seedance 1.5 Pro 目前是无可匹敌的。它证明了 AI 视频的未来不仅仅是像素——而是 声音与视觉 的无缝联姻。

LTX-2 (LTX Video) 评测:首个开源的“音视同步”基础模型

Lightricks LTX-2 彻底改变了 AI 视频:原生 4K、50 FPS、音视同步,且支持在 16GB 显存上运行(FP8)。立即在线试用或查看 ComfyUI 指南。

Kling 3 4k Vs Pro

SEO-friendly description for search engines

Kling 3 4k Workflow

SEO-friendly description for search engines

Kling 3 Native 4k

SEO-friendly description for search engines

HappyHorse AI 视频生成模型:这款新模型能做什么

了解 HappyHorse 这款新的视频生成模型,支持 text-to-video、image-to-video、video-to-video、原生音频与更适合创作者的工作流。

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

探索全新 Wan 2.7 Image 模型的高级编辑和 3K 文本渲染功能如何为 Kling 2.6 视频生成打造完美的资产工作流。

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.

音画同步实战指南:Kling Video 3.0 Omni 对口型深度教程

Kling Video 3.0 Omni 原生视听能力完整攻略。学习如何实现精准对口型、音画同步直出、复杂情感再现,打造专业级AI视频内容。