Конец монополии Nvidia: Как GLM-Image и чип Huawei Ascend возглавили мировые рейтинги ИИ

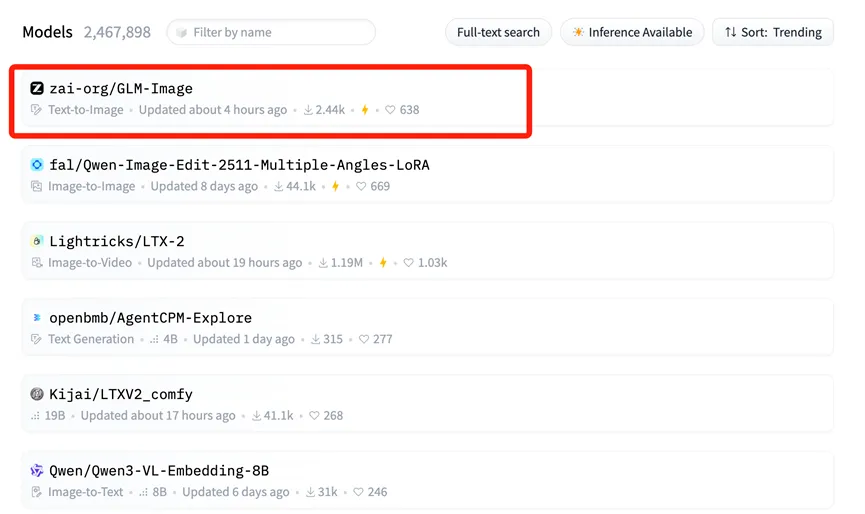

14 января в мировом ландшафте искусственного интеллекта произошел тектонический сдвиг, привлекший внимание как промышленных игроков, так и рынков капитала по всему миру. GLM-Image, мультимодальная модель генерации изображений, совместно разработанная Zhipu AI и Huawei, заняла первое место в списке трендов (Trending) Hugging Face.

Для непосвященных, Hugging Face — это по сути «Всемирная выставка» моделей с открытым исходным кодом, центральный хаб, где международные гиганты и разработчики демонстрируют свои лучшие ИИ-инструменты. Попадание на вершину списка трендов сродни выходу на главную сцену ведущей мировой технологической конференции, что означает международное признание технического мастерства и прикладной ценности GLM-Image.

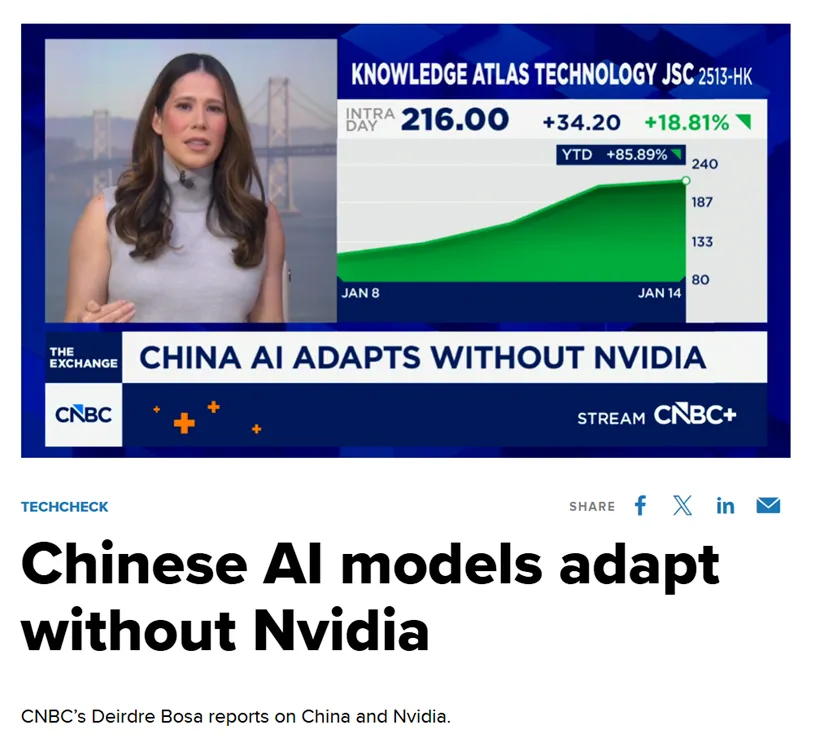

Американское СМИ CNBC отметило, что эта передовая модель, обученная Zhipu и Huawei, эффективно «разрушает миф» о зависимости от американских чипов. Это достижение не случайно; это неизбежный результат глубокой «синергии программного и аппаратного обеспечения» и прорыва во всей внутренней цепочке ИИ-индустрии Китая.

Фундамент «Full-Stack»: Huawei Ascend и MindSpore

Ключевой опорой этого достижения является отечественная база вычислительных мощностей, построенная Huawei.

В отличие от большинства предыдущих моделей ИИ, которые для обучения в значительной степени полагались на зарубежные GPU (в основном Nvidia), GLM-Image прошла весь свой жизненный цикл — от предварительной обработки данных до масштабного обучения — на чипах Huawei Ascend 800T A2 и ИИ-фреймворке MindSpore.

Эта полностью автономная комбинация «железо + фреймворк» и есть главная новость. Она решает основную проблему «узкого горлышка» в развитии ИИ, доказывая, что обучение передовых моделей (SOTA) возможно без зависимости от экосистемы CUDA. Серия Ascend 910B (на которой работает 800T A2) продемонстрировала внушительную производительность в крупных кластерных средах, предлагая жизнеспособную альтернативу для глобального сообщества Open Source.

Разбор архитектуры: Почему AR + Diffusion это важно

Zhipu AI также добилась значительных инноваций в архитектуре модели. GLM-Image отошла от стандартных технических маршрутов, используемых многими западными моделями с открытым исходным кодом.

Вместо этого она использует гибридную архитектуру «Авторегрессия (AR) + Диффузионный декодер».

- «Мозг» (Авторегрессия): AR-модель с 9 миллиардами (9B) параметров отвечает за понимание сложных инструкций, планирование макета и генерацию текста внутри изображений.

- «Художник» (Диффузия): Диффузионная модель с 7 миллиардами (7B) параметров выступает в роли декодера, заполняя детали высокой четкости на основе чертежа AR-модели.

Этот подход решает печально известную проблему в генерации изображений ИИ: точный рендеринг текста. Ранее изображения, созданные ИИ, часто содержали искаженный, нечитаемый текст. Благодаря сильным когнитивным способностям компонента AR, GLM-Image достигла самой высокой точности в генерации китайских иероглифов среди моделей с открытым исходным кодом.

Этот технический путь — приоритизация когнитивного понимания перед генерацией — зеркально отражает подход, наблюдаемый в передовых моделях когнитивного мышления, таких как Nano Banana Pro, которые фокусируются на «знаниях + рассуждениях» для выполнения сложных задач с большей точностью, чем стандартные генеративные модели.

Реакция рынка: Взлет Knowledge Atlas (2513.HK)

Ценность «золотого стандарта» лидерства в мировом чарте немедленно отразилась на реакции рынка капитала. Когда появилась новость об открытии исходного кода GLM-Image, цена акций материнской компании Zhipu AI, Knowledge Atlas (2513.HK), взлетела более чем на 16% за один день. Инвесторы четко осознали долгосрочную ценность комбинации «отечественный чип + автономная модель».

Фактически, с момента листинга на Гонконгской фондовой бирже 8 января в качестве «первой глобальной акции больших моделей», цена акций Knowledge Atlas выросла более чем на 100%.

Демократизация ИИ-дизайна: Open Source для всех

В долгосрочной перспективе успех GLM-Image обусловлен синергией всей производственной цепочки. Эта возможность полной цепочки служит не только технологическим гигантам; она значительно снижает барьеры для малого и среднего бизнеса (SME).

При стоимости инференса всего 0,1 юаня (около 0,01 доллара США) за изображение, GLM-Image позволяет компаниям использовать инструменты ИИ-дизайна высшего уровня за долю от традиционных затрат.

Сегодня исходный код и веса для GLM-Image доступны синхронно на GitHub и Hugging Face. Разработчики по всему миру теперь могут свободно использовать это «полностью автономное решение», ломая традиционный нарратив о том, что обучение передовых моделей зависит исключительно от американского кремния.

Почему удалили Seedance 2.0? Вся правда о видео StormCrew и крахе Kling 3.0

Обзор StormCrew спровоцировал панический бан Seedance 2.0. Узнайте, почему его 10-кратная эффективность и технология дистилляции уничтожают Kling 3.0.

Kling 3 Just Dropped: Will Wan 3 Be the Next Big Shock? (The AI Video Arms Race)

Война ИИ-видео накаляется. С установлением Kling 3 нового стандарта мы анализируем соперничество, историю Аудио-битв и прогнозируем, что нужно сделать Wan 3, чтобы выжить.

Kling 3 4k Vs Pro

SEO-friendly description for search engines

Kling 3 4k Workflow

SEO-friendly description for search engines

Kling 3 Native 4k

SEO-friendly description for search engines

HappyHorse AI Video Generator: что умеет новая модель

Познакомьтесь с HappyHorse — новой моделью генерации видео с text-to-video, image-to-video, video-to-video, нативным аудио и workflow для создателей.

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.

Освоение аудио-визуальной синхронизации: Практическое руководство по Kling Video 3.0 Omni

Комплексное руководство по возможностям нативной аудио-визуальной синхронизации Kling Video 3.0 Omni. Узнайте, как добиться точного движения рта ИИ, идеального липсинка и воспроизведения сложных эмоций для профессионального контента.