Kling 3.0 vs HappyHorse 1.0: Produktionsnaher Vergleich (Qualität, Kontrolle, Audio, API)

Kling 3.0 vs HappyHorse 1.0: schnell entscheiden (ohne dem Hype zu folgen)

Wenn du Kling 3.0 vs HappyHorse 1.0 suchst, willst du vermutlich eine klare Antwort: Welches Modell ist „besser“?

In der Produktion hängt „besser“ davon ab, was du tatsächlich auslieferst:

- Short‑Form Ad Loops (TikTok / Reels / Shorts)

- wöchentlich iterierte Produkt-Demos

- Creator‑Workflows, bei denen Audio und Timing wichtig sind

- API‑Pipelines, bei denen Zuverlässigkeit und Parameter das eigentliche Produkt sind

Diese Anleitung ist für Teams, die schnell entscheiden wollen. Du bekommst:

- eine realitätsnahe Zusammenfassung öffentlicher Aussagen

- eine Entscheidungsmatrix für 60 Sekunden

- eine wiederholbare Minimum Viable Evaluation (MVE)

- ein Failure‑Mode Playbook (Symptom → schnellster Fix)

Quick glossary (damit „Kling 3.0 vs HappyHorse 1.0“ Threads Sinn ergeben)

In Kling 3.0 vs HappyHorse 1.0 Diskussionen werden Modellnamen, Provider, Endpoints und Metriken oft vermischt. Hier ist ein kurzer Glossar-Block, der auch für jede AI video model comparison funktioniert:

- Kling AI 3.0: die Kling‑3.0‑Familie (Release‑Kontext Feb 2026).

- HappyHorse-1.0: die Modellbezeichnung, wie sie Provider üblicherweise verwenden.

- text-to-video model: Generierung nur aus Text.

- image-to-video model: Animation aus einem Still.

- reference-to-video: Referenzen nutzen, um Identity Drift zu reduzieren.

- Elo ranking: Blind‑Preference‑Signal (hilfreich, aber nicht ausreichend).

- duration limit: Sekunden‑Limit pro Clip, das Stitching erzwingt.

- prompt drift / identity drift: typische Fehlerbilder, die du bewerten musst.

Die wichtigste Frage zuerst: Was lieferst du aus?

Die schnellste Auflösung von Kling 3.0 vs HappyHorse 1.0 ist, vor dem Generieren klare Acceptance Gates zu definieren.

Acceptance gate #1: Konsistenz (bleibt es über Zeit stabil?)

Bei Kling 3.0 comparison / HappyHorse 1.0 comparison wird „Qualität“ oft mit „Schärfe“ verwechselt. In der Praxis scheitern Teams aber an zeitlicher Stabilität:

- identity drift (Gesicht/Haare/Kleidung wechseln)

- lighting drift (Stimmung/Color Temperature driftet)

- motion artifacts (Warping an Händen/Zähnen/Text)

Acceptance gate #2: Kontrolle (kannst du den Shot „regieren“?)

Kontrolle macht aus einem text-to-video model ein Produktionstool:

- Kamera‑Disziplin (kein random Zoom/Shake)

- Shot‑Disziplin (Wide/Medium/Close bleibt stabil)

- Intent‑Disziplin (das Modell „improvisiert“ nicht weg)

Acceptance gate #3: Dauer (brauchst du mehr als Micro‑Clips?)

Öffentliche Quellen nennen oft „bis ~15s“. Operativ heißt das: Kannst du einen Beat in einem Clip ausliefern oder brauchst du Stitching?

Acceptance gate #4: Audio‑Erwartung (silent-first oder audio-in-the-loop?)

Audio ist eine Workflow‑Entscheidung:

- silent-first: Video zuerst, Audio in Post (visuell schnell, final langsamer)

- audio-in-the-loop: Video + Audio zusammen (weniger Post, höhere Sync‑Erwartung)

Kling AI positioniert Kling 3.0 öffentlich mit native audio generation im Workflow.

Acceptance gate #5: Integration & Economics (API, Endpoints, Kosten)

Eine AI video model comparison ist ohne diese Fragen unvollständig:

- API oder nur Consumer UI?

- Endpoints für T2V/I2V/reference/edit?

- planbare cost‑per‑minute und Iterations‑Count?

- standardisierte Settings im Team?

Was öffentliche Quellen behaupten (und was sie nicht garantieren)

Kling AI 3.0 claims at-a-glance

Die Kling‑AI‑3.0‑Ankündigung (Feb 5, 2026) beschreibt eine Modellfamilie (Video 3.0 / Video 3.0 Omni / Image 3.0 / Image 3.0 Omni) mit Highlights:

- bessere Konsistenz/Realismus

- bis ~15 Sekunden pro Generation

- native Audio (Video + Audio zusammen)

- unified multimodal Architektur

- Multi‑Shot Storyboarding (insb. „Omni“)

Quelle: Kuaishou IR (Kling AI 3.0 Launch)

Was das nicht garantiert:

- dass dein Charakter in deinen Prompts stabil bleibt

- dass Audio‑Sync deine Brand‑Schwelle trifft

Es deutet aber darauf hin, dass Kling AI 3.0 auf narrative Kontrolle und audiovisuelle Vollständigkeit optimiert ist.

HappyHorse 1.0 claims at-a-glance

HappyHorse 1.0 (häufig HappyHorse-1.0) wird öffentlich als sehr hoch geranktes Modell beschrieben und über API‑Partner verfügbar gemacht.

Zwei öffentliche Anker:

-

WSJ (Apr 10, 2026) ordnet das Modell Alibaba zu und erwähnt Top‑Ranking nach Debüt:

https://www.wsj.com/tech/ai/alibabas-new-ai-video-generation-model-tops-global-ranking-after-debut-801fe3f7 -

PRNewswire (Apr 27, 2026) nennt fal als API‑Partner mit Endpoints für T2V/I2V/reference/video-edit:

https://www.prnewswire.com/news-releases/fal-launches-happyhorse-1-0--the-1-ranked-ai-video-model-as-official-api-partner-302755003.html

Was das nicht garantiert:

- dass ein #1 Ranking deine Ziel‑Scenes perfekt abdeckt

- dass Provider‑Defaults identisch zu Demos sind

Es deutet aber auf API‑First Nutzung mit mehreren Endpoints hin.

Leaderboard reality check: Elo ist hilfreich, aber nicht genug

Blind‑Preference‑Leaderboards sind ein Signal für wahrgenommene Qualität. Sie ersetzen aber keine Produktions‑Evaluation von Kling 3.0 vs HappyHorse 1.0.

Typische Fehlinterpretationen:

Misread #1: „#1 passt automatisch zu meinem Workflow“

Ein Modell kann „gewinnen“ und trotzdem operativ weh tun (Drift, Kamera‑Chaos, fragile Commercial‑Scenes).

Misread #2: „Leaderboard Prompt = Production Prompt“

Production‑Prompts sind oft restriktiver: brand‑safe, wiederholbar, format‑stabil.

Misread #3: „Ich brauche keinen Test‑Harness“

Du brauchst eine MVE, weil deine Constraints (Ratio, Audio, Budget, Provider‑Limits) anders sind.

Decision matrix (in 60 Sekunden default wählen)

| Priorität | Kling AI 3.0, wenn… | HappyHorse-1.0, wenn… |

|---|---|---|

| Konsistenz in Story‑Clips | du Narrative & Sequenzierung priorisierst | du Single‑Clip Best‑Case priorisierst und selbst nachtestest |

| Shot Control / Storyboards | du Storyboarding/Regie‑Features willst | du Kontrolle über Referenzen + Prompt‑Specs aufbaust |

| Audio im Loop | du native Audio im Generations‑Flow willst | du silent-first akzeptierst oder Audio später anfügst |

| API Integration | du aktuell UI‑first bist | du Endpoints (T2V/I2V/reference/edit) als Kern brauchst |

| Budgeting | du Iterations‑Limits managst | du klare Provider‑Preissignale brauchst |

Minimum viable evaluation (MVE): 30‑Minuten Test Harness

Nach jeder AI video model comparison: gleiche 3 Tests auf beiden Seiten, gleiche Rubrik, gleiche Settings.

How to run the test (fast)

- wähle ein Ziel‑Aspect‑Ratio (9:16 oder 16:9)

- vergleiche nicht 4s gegen 15s

- bewerte schnell (nicht im ersten Run „Prompt‑Optimierung bis zum Sieg“)

Test prompt set (3 Szenen)

Test 1: Commercial Studio Product (Realismus + Stabilität)

Product demo in a clean bright studio. A single smartphone on a minimal pedestal.

Camera: slow controlled orbit, no sudden zoom, no shaky motion. Keep framing stable.

Lighting: softbox key light, gentle reflections, no flicker. Background: plain gradient.

No text overlays, no logos, no extra products.

Test 2: Human performance + subtle motion (Identity Drift)

A person standing in a softly lit room, speaking a short line while gesturing naturally.

Camera: locked-off, medium shot, no zoom. Keep the face stable and realistic.

Avoid artifacts in hands, teeth, and eyes. No text, no brand marks.

Test 3: Two-beat micro story (Kontinuität)

Two-beat scene: (1) close-up of a coffee cup being placed on a desk, (2) medium shot of a person sitting down and opening a laptop.

Keep the scene consistent: same room, same lighting, same person.

Camera moves should be smooth and intentional. No random cuts.

Scoring rubric

- Consistency

- Control

- Artifacts

- Audio fit (falls aktiviert)

- Iteration cost (wie viele Versuche bis „ship-ready“?)

One-change-per-iteration

Ändere pro Iteration nur eine Variable (Kamera, Subject, Lighting, Motion, Reference).

Failure-mode playbook (Symptom → Fix)

Symptom: identity drift

- Prompt‑Entropie reduzieren

- reference-to-video nutzen

- harte Constraints statt „cinematic“ Adjektive

Symptom: camera chaos

- eine Kamera‑Regel wählen (locked-off oder slow orbit)

- Action‑Movie Wörter entfernen

- „no sudden zoom / no shaky motion“ als harte Regel wiederholen

Symptom: motion artifacts

- Aktion vereinfachen

- High‑frequency Patterns vermeiden

- falls edit möglich: near-miss fixen statt komplett neu

Symptom: audio mismatch

- Audio als Gate behandeln (an oder aus)

- kurze Lines zuerst

- prüfen, ob echtes lip-sync unterstützt wird

Procurement checklist

- Modell vs Provider‑Implementierung

- Endpoints (T2V/I2V/reference/edit)

- Team‑Standardisierung

- Budget (cost‑per‑minute + Iterations‑Count)

Provider fragmentation

Gleicher Modellname ≠ gleiche Defaults/Limitierungen/Preise. Harness behalten und bei Provider‑Wechsel neu laufen lassen.

Recommended workflows (safe defaults)

Workflow A: Short‑Form Ad Loop

Nutze das 3‑Test‑Harness für Kling 3.0 vs HappyHorse 1.0 und iteriere kontrolliert. Wenn Kontrolle + audiovisuelle Vollständigkeit dein Bottleneck ist, starte mit Kling AI 3.0. Wenn Endpoints/Automation dein Bottleneck ist, starte mit HappyHorse-1.0.

Workflow B: Product‑Demo Loop

Stabiles Prompt‑Template und wöchentliches A/B zwischen Kling AI 3.0 und HappyHorse-1.0.

Search variants

- Kling 3.0 vs HappyHorse 1.0

- HappyHorse 1.0 vs Kling 3.0

- Kling AI 3.0

- HappyHorse-1.0

- AI video model comparison

- text-to-video model

- image-to-video model

Kurzfassung: Kling 3.0 vs HappyHorse 1.0 ist ein Vergleich zwischen Kling AI 3.0 und HappyHorse-1.0 über text-to-video und image-to-video Workflows.

Verdict

Kein universeller Sieger. Wähle einen Default, teste mit MVE, standardisiere Templates.

Optional: run the same loop with our tools

Start here:

Audit receipt (DE)

Facts, URLs, and structure are locked to the EN master.

After localization, run: node scripts/audit-blog.mjs kling-3-0-vs-happyhorse-1-0 --locales de

Kling 3.0 vs. Runway Gen-4.5: Der ultimative KI-Video-Showdown (Vergleich 2026)

Ein umfassender Vergleich für 2026. Wir testen Kling 3.0 vs. Runway Gen-4.5 (Flagship) und Kling 2.6 vs. Gen-4 (Standard). Entdecken Sie, welcher KI-Videogenerator die besten täglichen kostenlosen Credits bietet.

Kling 3 vs Kling 2.6: The Ultimate Comparison & User Guide (2026)

Kling 3 Video ist da, mit Omni Models und nativem Lip-Sync. Wie schneidet es im Vergleich zu Kling 2.6 ab? Wir analysieren die Unterschiede, Funktionen und welches Klingai-Tool du wählen solltest.

GPT Image 2 360 VR Background: Lieferworkflow f��r nahtlose Equirectangular-Panoramen

Lieferbar statt nur ?breit��: gpt image 2 360 panorama, 2:1 equirectangular, Seam-Fix und Viewer-QA.

Kling 3 4K vs Pro (1080p): Wann sich 4K lohnt (und wann nicht)

Ein praktischer Entscheidungsrahmen fuer Kling 3 4K vs Pro (1080p): wann 4K Detail, Motion und Kompression verbessert - und wann 1080p der bessere Default ist.

Kling 3 4K workflow: Prompts, Shot-Planung und Export-Settings, die wirklich halten

Kling 3 4K workflow fuer brauchbare Deliverables: Two-pass Iteration, Prompt-Templates, safe complexity Regeln und Export-Hygiene fuer Plattform-Rekompression.

Kling 3 native 4K: Was sich bei Qualitaet, Bewegung, Kompression und realer Nutzung wirklich aendert

Was Kling 3 native 4K gegenueber 1080p veraendert: schaerfere Details, stabilere Bewegung, weniger Artefakte - und wann 4K wirklich sinnvoll ist.

HappyHorse AI Video Generator: Was das neue Modell kann

Entdecken Sie HappyHorse, ein neues KI-Videomodell mit Text-zu-Video, Bild-zu-Video, Video-zu-Video, nativer Audioausgabe und kreatorfokussierten Workflows.

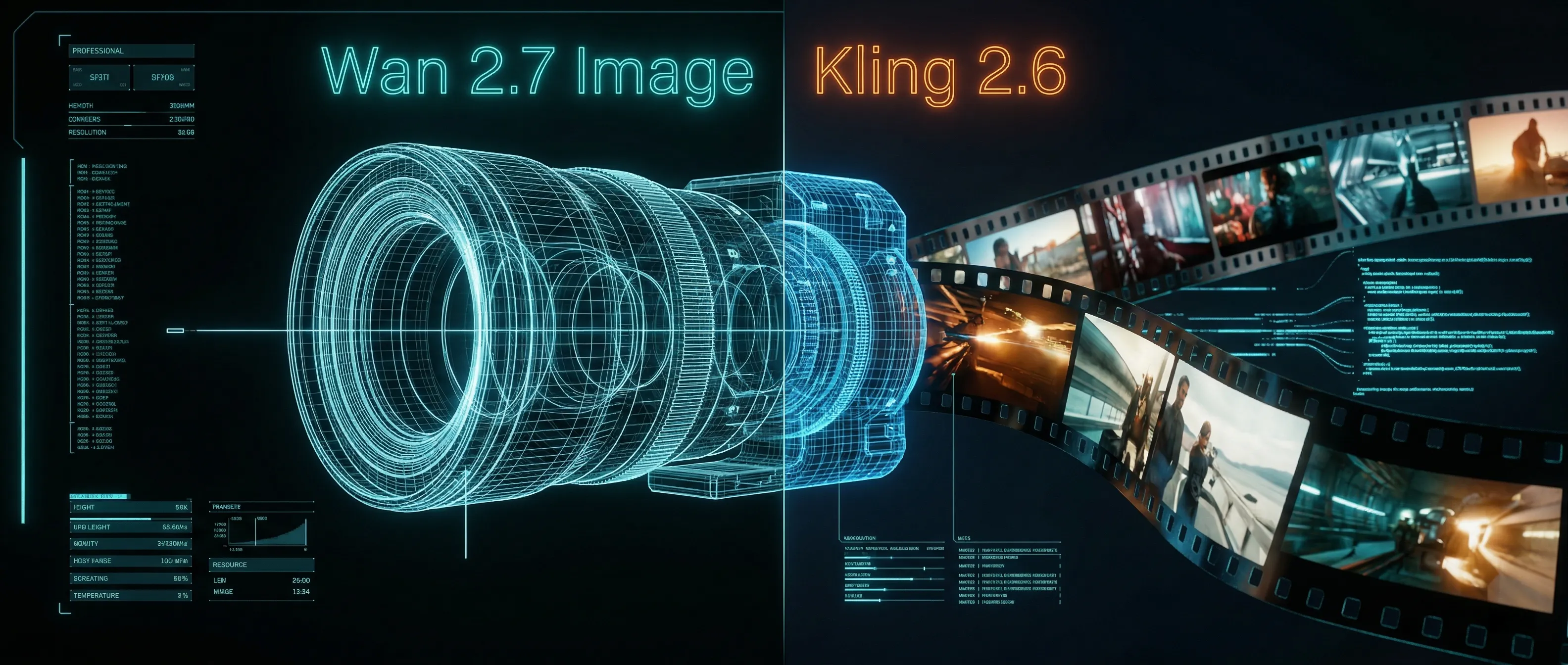

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

Entdecken Sie, wie die fortschrittlichen Bearbeitungs- und 3K-Text-Rendering-Funktionen des neuen Wan 2.7 Image-Modells die perfekte Asset-Pipeline für die Kling 2.6-Videogenerierung schaffen.