LTX-2 (LTX Video) レビュー:初のオープンソース「視聴覚」基盤モデル

Hunyuan(混元)とWan 2.1の間でAIビデオ戦争が落ち着きつつあると思われた矢先、Lightricksが爆弾を投下しました。LTX-2(旧称 LTX Video)が正式にオープンウェイトでリリースされました。これは単なるビデオジェネレーターではありません。

これは、音声・動画の同時生成(Joint Audiovisual Generation) が可能な世界初のオープンウェイト基盤モデルです。つまり、ビデオと同期したオーディオを一度のパスで同時に作成します。

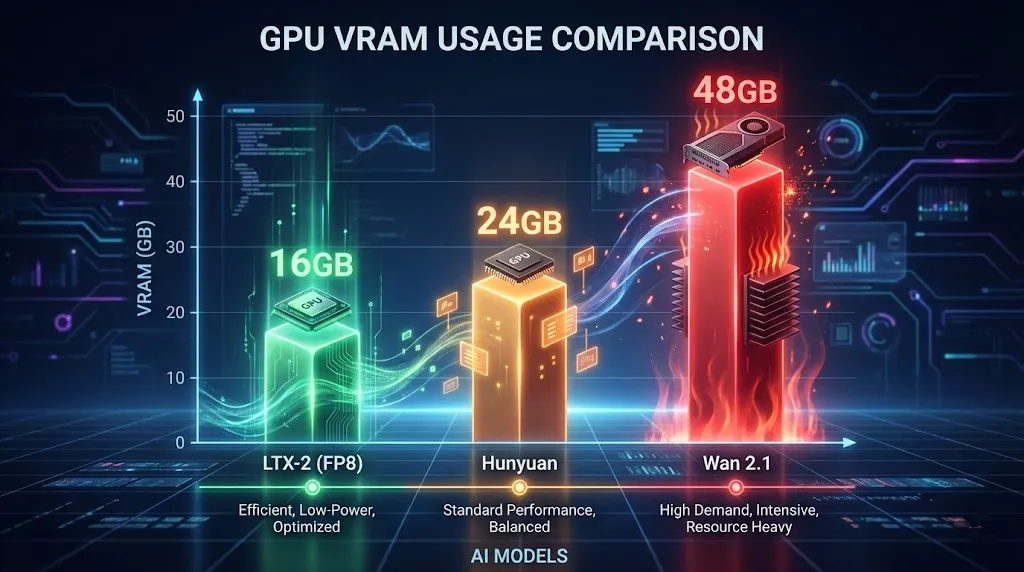

しかし、ローカルユーザーにとっての真のニュースは 効率性 です。VRAMを大量に消費するHunyuan Videoとは異なり、LTX-2は16GBのコンシューマー向けGPUで快適に動作し(NVFP8量子化を使用)、他のモデルがスローモーションでレンダリングしているかのように感じさせるほどのリアルタイムに近い生成速度を実現します。

2026年に音声を生成でき、かつGPUを溶かさないオープンソースAIビデオジェネレーターを探しているなら、これが答えです。このガイドでは、スペックを深く掘り下げ、LTX-2 vs Hunyuan Video を比較し、今すぐ使い始める方法を紹介します。

革新:音声と動画の同時生成

Lightricksは、サウンドデザインという大きな悩みの種を解決しました。 新しい DiT(Diffusion Transformer) アーキテクチャに基づいて構築されたLTX-2は、動きと音の相関関係を理解しています。

- 仕組み: 「ガラスが割れる」とプロンプトに入力すると、モデルは破片が飛び散る視覚的な映像と、同期したガラスが割れる音を 即座に 生成します。

- 重要性: ストック効果音を探したり、ポストプロダクションでオーディオを苦労して同期させたりする必要はもうありません。すべてネイティブに生成されます。

主な仕様

- 解像度: ネイティブ4Kサポート(ローカルGPU向けに720pに最適化)。

- フレームレート: 滑らかな動きのための最大 50 FPS(標準は24 FPS)。

- オーディオ: ネイティブ同期オーディオ生成(48kHzステレオ)。

- ライセンス: 商用利用無料(年間収益が1,000万ドル未満の事業体向け、つまり <$10M)。

ハードウェア要件:動作しますか?

ここがLTX-2の輝くところです。Run LTX Video locally 24GB VRAM が4Kには理想的ですが、このモデルは NVFP8量子化 を使用してミドルレンジのカードに適合します。

720p(4秒)の最小スペック

- GPU: NVIDIA RTX 3080 / 4070 Ti / 4080 (12GB - 16GB VRAM)。

- RAM: 32GB システムRAM。

- ストレージ: 50GB SSD容量。

「Run LTX Video locally 16GB VRAM(LTX Videoはローカル16GB VRAMで動くか)」と尋ねる方へ—はい、間違いなく動きます。 ComfyUIでFP8テキストエンコーダーとモデルウェイトを有効にすることで、OOM(メモリ不足)エラーに遭遇することなく 720p / 24fps / 4秒のクリップ を生成できます。

LTX-2 vs Hunyuan Video:直接対決

私たちは両方のモデルを広範囲にテストしました。2026年の判定は以下の通りです。

| 機能 | LTX-2 (Lightricks) | Hunyuan Video | Wan 2.1 |

|---|---|---|---|

| オーディオ | ネイティブ同期 (勝者) | なし | なし |

| 速度 | 高速 (FP8) | 中程度 | 低速 (高品質) |

| VRAM | 16GB フレンドリー | 24GB+ 推奨 | 48GB+ (エンタープライズ) |

| 一貫性 | 良好 (短いクリップ) | 優秀 | クラス最高 |

| ライセンス | コミュニティ (<$10M) | オープンソース | オープンソース |

判定: ソーシャルメディアコンテンツ、音楽ビジュアライザー、そして 音 が重要なシナリオには LTX-2 を選んでください。ハリウッドレベルの視覚的一貫性が必要で、オーディオを気にしない場合は、Hunyuan または Wan 2.1 を選んでください。

チュートリアル:LTX-2の使用方法(オンライン vs ローカル)

このモデルを実行するには2つのオプションがあります。

オプション 1:最も簡単な方法(推奨)

LTX-2を使用するために2,000ドルのGPUは必要ありません。私たちはフルモデルをプラットフォームに直接統合しました。

- インストール不要: すぐに使えます。

- 高速生成: クラウドを使用。

- インスタントプレビュー: 視聴覚同期プレビュー。

今すぐオンラインでLTX-2を試す (クリックして生成を開始)。

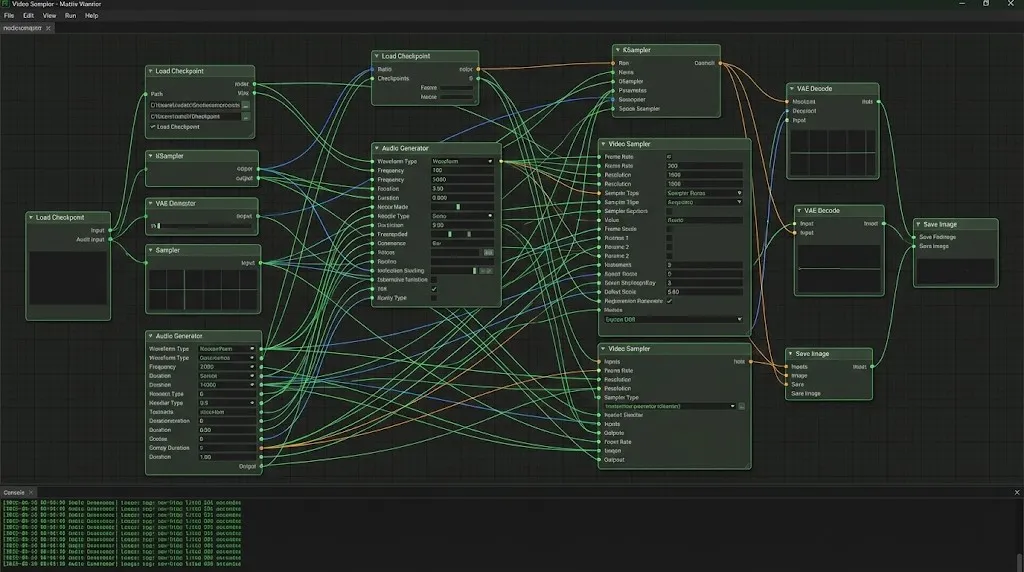

オプション 2:ローカルComfyUIセットアップ(開発者向け)

ローカルで実行したい場合は、以下の手順に従ってください:

- カスタムノードのインストール: Managerで

ComfyUI-LTXVideoを検索します。 - ウェイトのダウンロード: Hugging Faceから

ltx-video-2b-v0.9.safetensors(FP8バージョン) を入手します。 - ワークフローのロード: LTX LoaderとSamplerを接続する標準的なワークフローを構築します。

- プロンプト実行: フレームを 97(約4秒)に設定して楽しみましょう。

プロのヒント: ローカルセットアップは、Pythonの依存関係のトラブルシューティングが必要になることがよくあります。エラーが発生した場合は、手間のかからないオンラインツールに切り替えることをお勧めします。

LTX-2 プロンプトエンジニアリングのヒント

良い結果を得るには、特定のプロンプト戦略が必要です。LTX-2は視覚的な手がかりと聴覚的な手がかりの両方を理解します。

1. 視聴覚プロンプト (Audio-Visual Prompts)

視覚的なプロンプトの中で音を記述します:

- プロンプト: "A cinematic shot of a thunderstorm, lightning strikes a tree, loud thunder crack, rain pouring sound."(雷雨の映画のようなショット、木に雷が落ちる、大きな雷鳴、激しい雨の音。)

- 結果: モデルは光の閃光を雷鳴のピークと同期させます。

2. カメラコントロール

ショットを演出するためにこれらを使用します:

LTX Video camera control prompts: "Camera pan right"(カメラ右パン), "Slow zoom in"(ゆっくりズームイン), "Drone shot"(ドローンショット), "Low angle"(ローアングル)。- 例: "Cinematic drone shot flying over a cyberpunk city, neon lights, fog, 4k, highly detailed, electronic synthesizer music background."

3. ネガティブプロンプトリスト

高速モデルによくある「顔が溶ける」現象を避けるために、この LTX Video ネガティブプロンプトリスト を使用してください:

"Blurry, distorted, morphing, jittery, watermarks, text, bad anatomy, static, frozen, silence, muted."

FAQ:トラブルシューティングと最適化

Q: ローカル生成が真っ暗な画面になります。

A: これは通常、間違ったVAE dtypeを使用している場合に発生します。GPUがサポートしている場合(RTX 30/40シリーズ)はVAEが bfloat16 に設定されていることを確認し、古いカードの場合は float32 に設定してください。

Q: LTX-2の設定を720pにするとPCがクラッシュします。

A: ComfyUIのbatファイルで --lowvram を有効にしてください。また、「フレーム数(frame count)」が最適なテンソルアライメントのために (8 * n) + 1 の式(例:97, 121)に従っていることを確認してください。

Q: 商用利用は可能ですか? A: はい! 年間収益が1,000万米ドル未満の場合、LTX-2 コミュニティライセンス は完全な商用利用を許可しています。

結論

Lightricks LTX-2 は、オープンソースAIにとって極めて重要な瞬間です。速度、オーディオ、アクセシビリティ を1つのパッケージに統合したモデルを手にしたのはこれが初めてです。

ピクセル単位の完璧な一貫性ではWan 2.1に及ばないかもしれませんが、 同期した視聴覚クリップ を生成できる能力は革命的です。ほとんどのクリエイターにとって、LTX-2 はついにAIビデオパーティーに音を持ち込むツールとなります。

Seedance 1.5 Pro レビュー:ByteDanceが贈る、完璧なリップシンクを備えた視聴覚の傑作

LTX-2が扉を開いた後、Seedance 1.5 Proがそれを完成させました。ネイティブな視聴覚同時生成、正確なリップシンク、そして複雑なカメラ制御を今すぐオンラインで体験。

Kling 3 4k Vs Pro

SEO-friendly description for search engines

Kling 3 4k Workflow

SEO-friendly description for search engines

Kling 3 Native 4k

SEO-friendly description for search engines

HappyHorse AI Video Generator: 新しいモデルで何ができるのか

HappyHorse は、text-to-video、image-to-video、video-to-video、ネイティブ音声、そしてクリエイター向けのワークフローを備えた新しいAI動画生成モデルです。

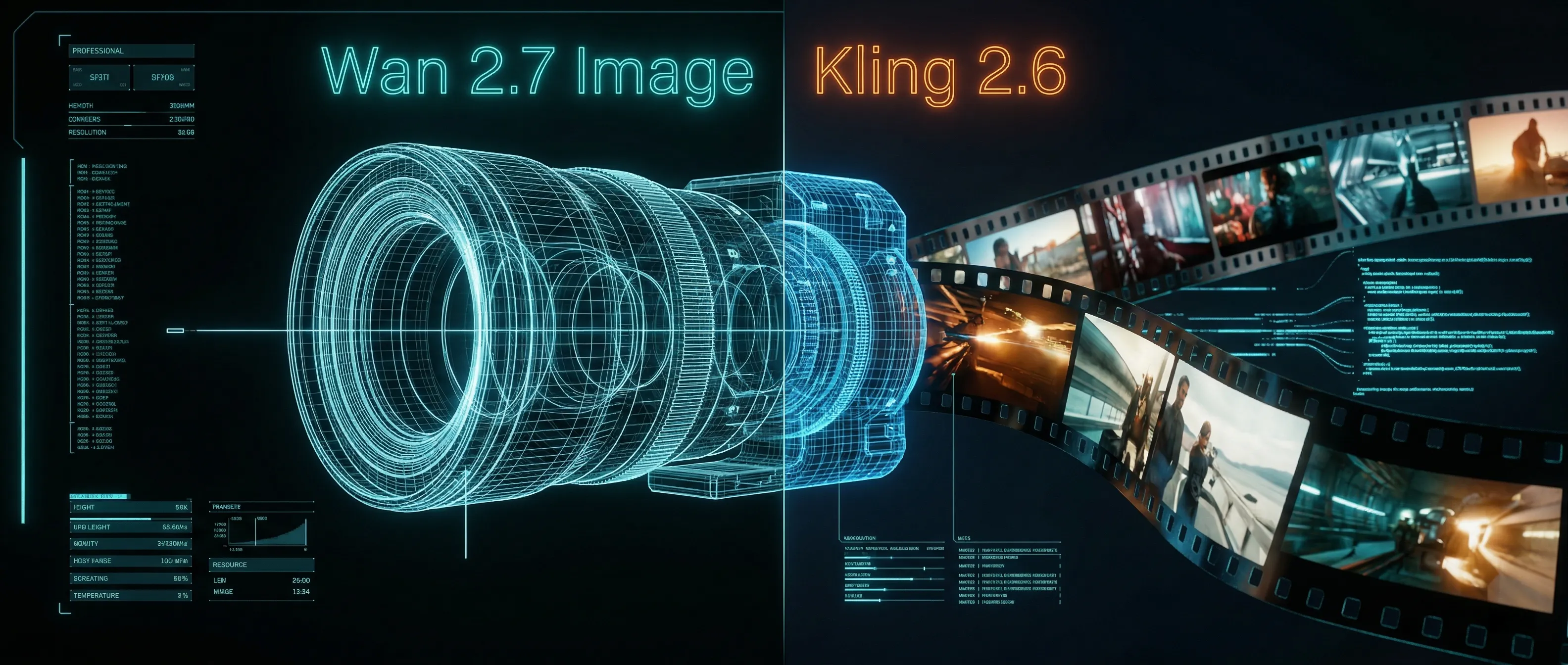

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

新しい Wan 2.7 Image の高度な編集と 3K テキストレンダリング機能が、Kling 2.6 の動画生成における完璧なアセットワークフローをどのように構築するかをご紹介します。

The Next Generation of Generation: Unpacking the Wan 2.7 Upgrade

The highly anticipated Wan 2.7 Video release marks a turning point, introducing a multi-modal injection system and a studio-grade workflow for creators.

Kling Video 3.0 Omniの音画同期完全攻略:実践ガイド

Kling Video 3.0 Omniのネイティブ音画同期機能を徹底解説。高精度な口パクAI、完璧なリップシンク、複雑な感情表現の再現を実現し、プロ級AI動画コンテンツを作成する方法を学びます。