Kling 3.0 vs HappyHorse 1.0:制作目線の比較(品質・制御・音声・API)

Kling 3.0 vs HappyHorse 1.0:ハイプに流されず最短で選ぶ

Kling 3.0 vs HappyHorse 1.0 を検索する人が欲しいのは「結局どっちが“強い”の?」という答えだと思います。

ただし制作現場では、「強い」は“何を納品するか”で決まります。

- 短尺広告ループ(TikTok / Reels / Shorts)

- 毎週回すプロダクトデモ

- クリエイター運用(音声・テンポが重要)

- API 前提の量産パイプライン(安定性とパラメータが本体)

このガイドは、議論を「好み」から「再現できる判断」に変えるためのものです。

- 公開情報の要点(何が言われているか/言われていないか)

- 60秒で決める Decision matrix

- 30分で回す最小評価(MVE)

- 失敗モード別の最短修正(symptom → fix)

Quick glossary(用語を揃える)

Kling 3.0 vs HappyHorse 1.0 のスレでは、モデル名・プロバイダ・エンドポイント・評価指標が混ざりがちです。ここだけ読めば議論の前提が揃います。

- Kling AI 3.0:Kling 3.0 ファミリー(2026年2月の発表文脈)

- HappyHorse-1.0:プロバイダが使う表記

- text-to-video model:テキストのみで生成

- image-to-video model:静止画から動画化

- reference-to-video:参照入力で identity drift を抑える

- Elo ranking:ブラインド嗜好の指標(有用だが十分条件ではない)

- duration limit:秒数上限(stitching 必要性に直結)

- prompt drift / identity drift:評価で必ず見る失敗パターン

Start with the only question that matters: what are you shipping?

Kling 3.0 vs HappyHorse 1.0 を最短で決めるコツは、生成前に acceptance gate(合否の条件)を固定することです。

ここでは、制作で本当に効く 5 つの gate を紹介します。

Acceptance gate #1: consistency (does it stay the same across time?)

「画がシャープか」より、制作で痛いのは時間的一貫性です。

- identity drift(顔・髪・服が変わる)

- lighting drift(雰囲気が途中でズレる)

- motion artifacts(手・歯・文字周りが歪む)

Acceptance gate #2: control (can you direct the shot?)

制御があるかどうかで、text-to-video model は「遊び」から「制作ツール」になります。

- カメラが勝手にズームしない

- 画角(wide/medium/close)が暴れない

- 意図から逸れない(勝手に演出を足さない)

Acceptance gate #3: duration (do you need more than a micro-clip?)

公開情報では「最大 ~15s」がよく出ます。

これは「1本で完結できるか/stitching が前提か」を左右します。

Acceptance gate #4: audio expectation (silent-first or audio-in-the-loop?)

音声はワークフロー選択です。

- silent-first:まず映像、音は後で(映像反復は速い)

- audio-in-the-loop:映像+音を同時(後工程は減るが同期期待が上がる)

Kling AI は Kling 3.0 を native audio generation を含むワークフローとして位置付けています(下で触れます)。

Acceptance gate #5: integration & economics (API, endpoints, cost predictability)

どんな AI video model comparison でも、最後はここで決まります。

- API があるか(or UI のみか)

- T2V / I2V / reference-to-video / edit の endpoints が揃うか

- cost-per-minute と iteration 回数が読めるか

- 設定をチームで標準化できるか

What public sources actually claim (and what they don’t)

この Kling 3.0 vs HappyHorse 1.0 は、公開情報の「主張」を整理しつつ、制作上あなたが自分で検証すべき点も明確にします。

Kling AI 3.0 claims at-a-glance

2026-02-05 の発表では、Kling AI 3.0 はモデルファミリー(Video 3.0 / Video 3.0 Omni / Image 3.0 / Image 3.0 Omni)として紹介され、概ね以下が強調されています。

- 一貫性・リアリズムの改善

- 最大 ~15 秒

- native audio generation

- 統合マルチモーダル

- multi-shot storyboarding(特に Omni)

What this doesn’t guarantee:

- あなたのプロンプトでキャラクターが常に安定すること

- 音声同期がブランド基準に達すること(口形・タイミング・スタイル)

制作的には、Kling AI 3.0 が「物語制御+視聴覚の一体生成」に寄せているサイン、と捉えるのが安全です。

HappyHorse 1.0 claims at-a-glance

HappyHorse 1.0(多くは HappyHorse-1.0)は、Artificial Analysis でのランキング言及や、API パートナー経由での提供が公開されています。

公開アンカー:

- WSJ(2026-04-10):

https://www.wsj.com/tech/ai/alibabas-new-ai-video-generation-model-tops-global-ranking-after-debut-801fe3f7 - PRNewswire(2026-04-27)fal の API パートナー告知:

https://www.prnewswire.com/news-releases/fal-launches-happyhorse-1-0--the-1-ranked-ai-video-model-as-official-api-partner-302755003.html

What this doesn’t guarantee:

- #1 ランキングがあなたの用途にそのまま当てはまること

- プロバイダのデフォルトがデモと一致すること

ただし「API-first に使える」「複数 endpoints を前提にしている」ことを示唆します。

Leaderboard reality check: Elo is useful, but only for one slice of truth

Artificial Analysis などの Elo は、ブラインド嗜好の「品質シグナル」です。

ただし Kling 3.0 vs HappyHorse 1.0 の制作勝者を決めるものではありません。

The 3 ways teams misread rankings

- #1=自分の制作ワークフローでも最強、と思い込む

- ランキング用 prompt を production prompt と混同する

- テスト harness を省略してしまう

Decision matrix (pick a default in 60 seconds)

| 優先事項 | Kling AI 3.0 向き | HappyHorse-1.0 向き |

|---|---|---|

| 連続性(ナラティブ) | 物語制御と連続性を重視 | 単発ベストケース重視+自前検証 |

| 音声込み納品 | audio-in-the-loop を前提 | silent-first でも回る |

| API 統合 | UI-first でも可 | endpoints を核に自動化 |

Minimum viable evaluation (MVE): a 30-minute test harness

同じ条件で 3 テストを回し、同じ rubric で採点してください。これが一番速いです。

How to run the test (fast)

- いつも納品する比率(9:16 or 16:9)を選ぶ

- 4s vs 15s のような不公平比較をしない

- まず採点(最初から最適化で勝ちに行かない)

Test prompts (3 scenes) + evaluation rubric

Test 1: Commercial studio product

Product demo in a clean bright studio. A single smartphone on a minimal pedestal.

Camera: slow controlled orbit, no sudden zoom, no shaky motion. Keep framing stable.

Lighting: softbox key light, gentle reflections, no flicker. Background: plain gradient.

No text overlays, no logos, no extra products.

Test 2: Human performance + subtle motion

A person standing in a softly lit room, speaking a short line while gesturing naturally.

Camera: locked-off, medium shot, no zoom. Keep the face stable and realistic.

Avoid artifacts in hands, teeth, and eyes. No text, no brand marks.

Test 3: Two-beat micro story

Two-beat scene: (1) close-up of a coffee cup being placed on a desk, (2) medium shot of a person sitting down and opening a laptop.

Keep the scene consistent: same room, same lighting, same person.

Camera moves should be smooth and intentional. No random cuts.

Scoring rubric (simple)

- Consistency

- Control

- Artifacts

- Audio fit(有効化する場合)

- Iteration cost(何回で「納品できる」出力になったか)

The one-change-per-iteration rule

1回の反復で変更は1つだけ(カメラ/主体/光/動き/reference)。

Failure-mode playbook (symptom → fastest fix)

Symptom: identity drift (face/hair/outfit changes)

- 形容詞を減らす(prompt entropy を下げる)

- reference-to-video を使う

- hard constraints(画角・光・服装)で固定する

Symptom: camera chaos (random zoom, shake, unwanted cuts)

- locked-off か slow controlled orbit に固定

- handheld / dramatic などを外す

- 「no sudden zoom / no shaky motion」を明記

Symptom: motion artifacts (hands/teeth/text warping)

- 動作を単純化

- 細かい柄を避ける

- edit があるなら near-miss を修正

Symptom: audio mismatch (timing feels off, lip-sync misses)

- 音声は gate として扱う(オン/オフを固定)

- 短い台詞から始める

- lip-sync なのか汎用 audio なのか切り分ける

Procurement checklist (teams + budgets)

- モデル本体か provider 実装か

- Endpoints(T2V/I2V/reference/edit)

- チーム標準化(設定・テンプレ)

- 予算(cost-per-minute + iteration)

The “provider fragmentation” trap

同名モデルでも provider により defaults/limits/pricing が異なります。harness を維持して乗り換え時に再評価してください。

Recommended workflows (safe defaults)

Workflow A: short-form ad loop

同じ 3 テストを回し、1回の反復で1点だけ変更する。

Workflow B: product-demo loop

固定テンプレで毎週 A/B を取り、継続的に品質を追う。

Search variants

- Kling 3.0 vs HappyHorse 1.0

- HappyHorse 1.0 vs Kling 3.0

- Kling AI 3.0

- HappyHorse-1.0

- AI video model comparison

- text-to-video model

- image-to-video model

Verdict: pick a default, then validate with your own clips

普遍的な勝者はありません。デフォルトを決め、MVE を回し、テンプレを固定するのが最短です。

Optional: use our tools to run the same evaluation loop

Start here:

Audit receipt (JA)

Facts, URLs, and structure are locked to the EN master.

After localization, run: node scripts/audit-blog.mjs kling-3-0-vs-happyhorse-1-0 --locales ja

Kling 3.0 vs Runway Gen-4.5:究極のAI動画生成対決(2026年比較版)

2026年版の包括的な比較レビュー。Kling 3.0 vs Runway Gen-4.5(フラッグシップ)およびKling 2.6 vs Gen-4(標準版)を徹底テスト。毎日無料クレジットを提供する最高のAI動画生成ツールはどれか、その答えを探ります。

Kling 3 vs Kling 2.6: The Ultimate Comparison & User Guide (2026)

Omni models とネイティブ Lip Sync を搭載した Kling 3 Video が登場しました。Kling 2.6 と比較してどうなのでしょうか?その違いや機能、そしてどちらの Klingai ツールを選ぶべきかを詳しく解説します。

GPT Image 2 360 VR Background:納品向けワークフロー(seamless equirectangular)

納品品質の VR 360 background:gpt image 2 360 panorama を 2:1 equirectangular で生成し、seam-fix と viewer QA を回す。

Kling 3 4k Vs Pro

SEO-friendly description for search engines

Kling 3 4k Workflow

SEO-friendly description for search engines

Kling 3 Native 4k

SEO-friendly description for search engines

HappyHorse AI Video Generator: 新しいモデルで何ができるのか

HappyHorse は、text-to-video、image-to-video、video-to-video、ネイティブ音声、そしてクリエイター向けのワークフローを備えた新しいAI動画生成モデルです。

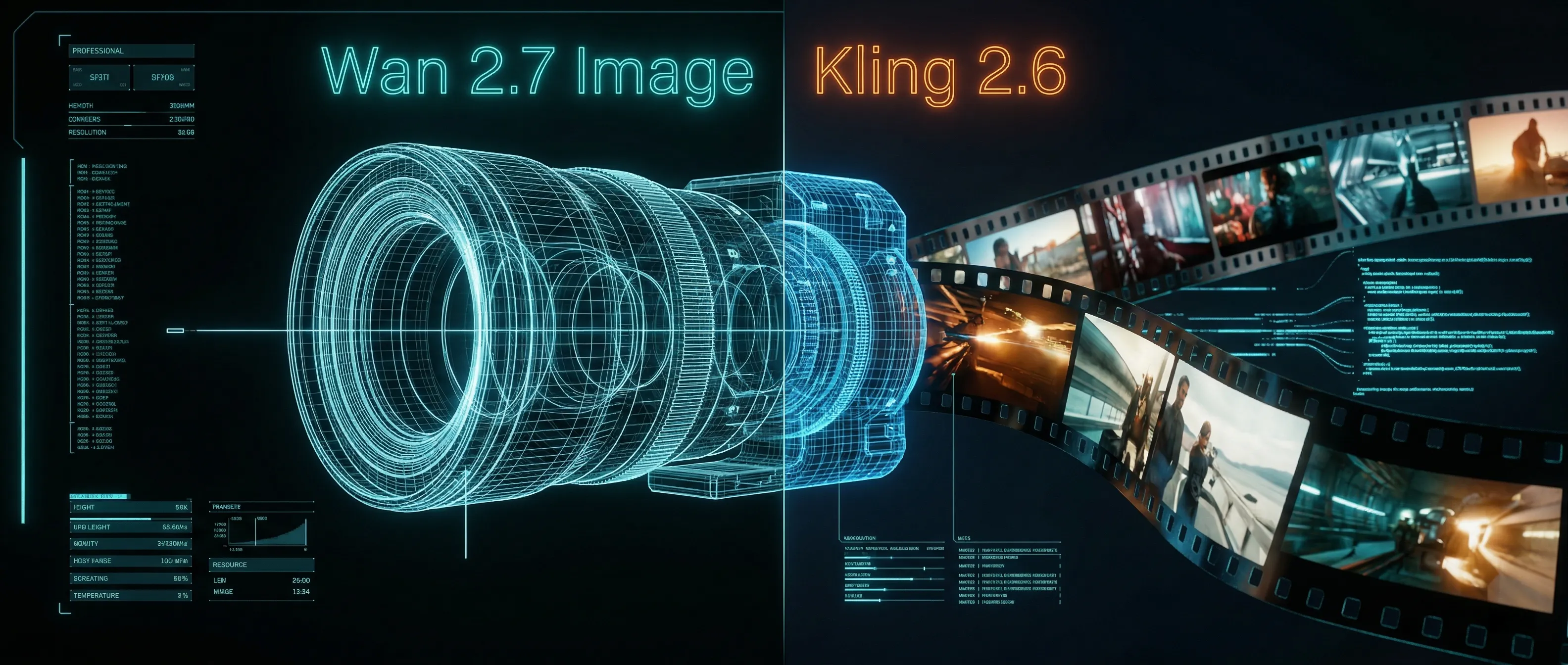

Wan 2.7 Image Meets Kling 2.6: The Ultimate AI Visual Workflow

新しい Wan 2.7 Image の高度な編集と 3K テキストレンダリング機能が、Kling 2.6 の動画生成における完璧なアセットワークフローをどのように構築するかをご紹介します。