Reseña de LTX-2 (LTX Video): El primer modelo "Audio-Visual" de código abierto

Justo cuando pensábamos que la guerra de videos de IA se estaba calmando entre Hunyuan y Wan 2.1, Lightricks lanzó una bomba. LTX-2 (anteriormente conocido como LTX Video) ha sido lanzado oficialmente con pesos abiertos (open weights), y no es solo otro generador de video.

Es el primer modelo fundacional de pesos abiertos del mundo capaz de generación audiovisual conjunta, lo que significa que crea video y audio sincronizado simultáneamente en una sola pasada.

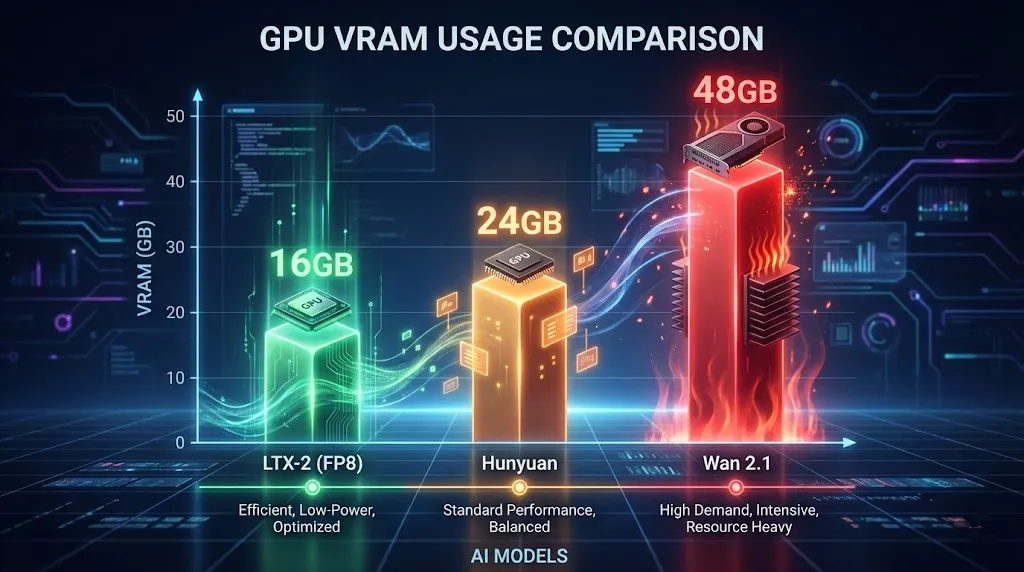

Pero ¿el verdadero titular para los usuarios locales? Eficiencia. A diferencia del Hunyuan Video que devora VRAM, LTX-2 se ejecuta cómodamente en GPU de consumo de 16GB (usando cuantización NVFP8), ofreciendo velocidades de generación casi en tiempo real que hacen que otros modelos parezcan estar renderizando en cámara lenta.

Si buscas un generador de video de IA de código abierto en 2026 que genere sonido y no derrita tu GPU, este es el indicado. En esta guía, profundizaremos en las especificaciones, compararemos LTX-2 vs Hunyuan Video, y te mostraremos cómo usarlo inmediatamente.

La Innovación: Generación Conjunta de Audio y Video

Lightricks ha resuelto un gran punto de dolor: el diseño de sonido. Construido sobre una novedosa arquitectura DiT (Diffusion Transformer), LTX-2 comprende la correlación entre el movimiento y el sonido.

- Cómo funciona: Cuando escribes el prompt "un vaso rompiéndose", el modelo genera instantáneamente los fragmentos volando visualmente y el sonido sincronizado del vidrio rompiéndose.

- Por qué importa: No más búsquedas de efectos de sonido de stock ni intentos de sincronizar audio laboriosamente en postproducción. Todo se genera de forma nativa.

Especificaciones Clave

- Resolución: Soporte nativo 4K (Optimizado para 720p en GPU locales).

- Tasa de fotogramas: Hasta 50 FPS para movimiento fluido (el estándar es 24 FPS).

- Audio: Generación de audio sincronizado nativo (estéreo de 48kHz).

- Licencia: Gratis para uso comercial (para entidades con <$10M de ingresos anuales).

Requisitos de Hardware: ¿Puedes ejecutarlo?

Aquí es donde brilla LTX-2. Mientras que Run LTX Video locally 24GB VRAM es ideal para 4K, el modelo utiliza cuantización NVFP8 para adaptarse a tarjetas de gama media.

Especificaciones Mínimas para 720p (4 Segundos)

- GPU: NVIDIA RTX 3080 / 4070 Ti / 4080 (12GB - 16GB VRAM).

- RAM: 32GB RAM del sistema.

- Almacenamiento: 50GB de espacio en SSD.

Para aquellos que preguntan, "Run LTX Video locally 16GB VRAM"—Sí, absolutamente. Al habilitar el codificador de texto FP8 y los pesos del modelo en ComfyUI, puedes generar clips de 720p / 24fps / 4s sin encontrar errores OOM (Out of Memory).

LTX-2 vs Hunyuan Video: El Enfrentamiento

Probamos ambos modelos extensivamente. Aquí está el veredicto para 2026.

| Característica | LTX-2 (Lightricks) | Hunyuan Video | Wan 2.1 |

|---|---|---|---|

| Audio | Sincronización Nativa (Ganador) | No | No |

| Velocidad | Rápido (FP8) | Moderada | Lento (Alta Calidad) |

| VRAM | Amigable con 16GB | 24GB+ Recomendado | 48GB+ (Empresarial) |

| Coherencia | Buena (Clips cortos) | Excelente | Mejor en su clase |

| Licencia | Comunidad (<$10M) | Código Abierto | Código Abierto |

Veredicto: Elige LTX-2 para contenido de redes sociales, visualizadores de música y escenarios donde el sonido es crucial. Elige Hunyuan o Wan 2.1 si necesitas coherencia visual de nivel Hollywood y no te importa el audio.

Tutorial: Cómo usar LTX-2 (Online vs Local)

Tienes dos opciones para ejecutar este modelo.

Opción 1: La manera más fácil (Recomendado)

No necesitas una GPU de $2000 para usar LTX-2. Hemos integrado el modelo completo directamente en nuestra plataforma.

- No requiere instalación.

- Generación rápida en nuestra nube.

- Vista previa audiovisual instantánea.

Prueba LTX-2 Online Ahora (Haz clic para empezar a generar).

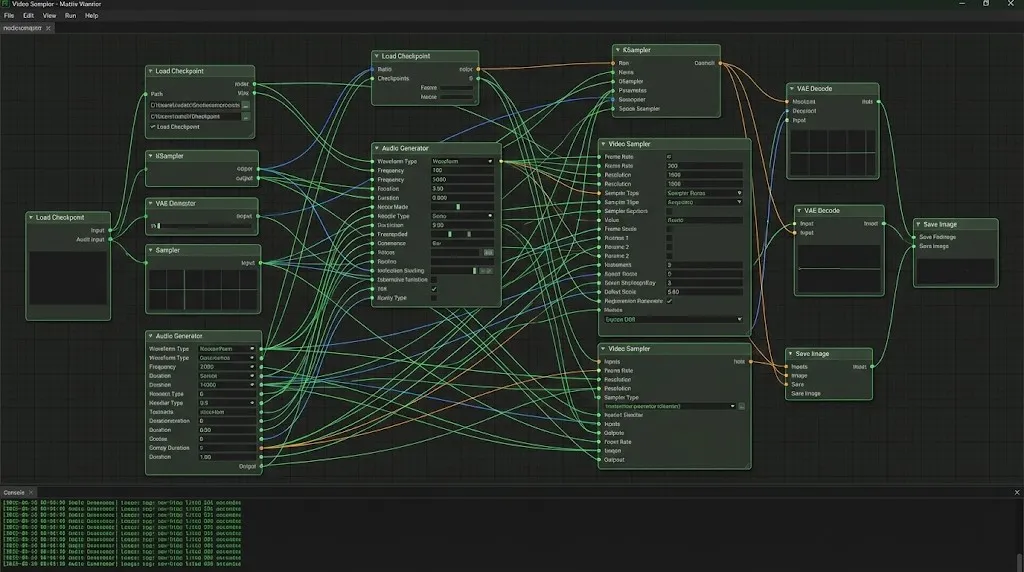

Opción 2: Configuración local de ComfyUI (Para desarrolladores)

Si prefieres ejecutarlo localmente, sigue estos pasos:

- Instalar Nodos Personalizados: Busca

ComfyUI-LTXVideoen el Manager. - Descargar Pesos: Obtén

ltx-video-2b-v0.9.safetensors(versión FP8) de Hugging Face. - Cargar Flujo de Trabajo: Construye un flujo de trabajo estándar conectando el LTX Loader al Sampler.

- Generar: Establece los fotogramas en 97 (aprox. 4 segundos) y disfruta.

Consejo Pro: La configuración local a menudo requiere solucionar problemas de dependencias de Python. Si encuentras errores, recomendamos cambiar a nuestra herramienta online para una experiencia sin complicaciones.

Consejos de Ingeniería de Prompts para LTX-2

Obtener buenos resultados requiere estrategias de prompts específicas. LTX-2 entiende tanto las señales visuales como las auditivas.

1. Prompts Audiovisuales

Describe el sonido dentro de tu prompt visual:

- Prompt: "A cinematic shot of a thunderstorm, lightning strikes a tree, loud thunder crack, rain pouring sound."

- Resultado: El modelo sincronizará el destello de luz con el pico de audio del trueno.

2. Control de Cámara

Usa estos para dirigir la toma:

LTX Video camera control prompts: "Camera pan right", "Slow zoom in", "Drone shot", "Low angle".- Ejemplo: "Cinematic drone shot flying over a cyberpunk city, neon lights, fog, 4k, highly detailed, electronic synthesizer music background."

3. La Lista de Prompts Negativos

Para evitar el efecto de "cara derritiéndose" común en modelos rápidos, usa esta lista de prompts negativos de LTX Video:

"Blurry, distorted, morphing, jittery, watermarks, text, bad anatomy, static, frozen, silence, muted."

FAQ: Solución de Problemas y Optimización

P: Mi generación local es solo una pantalla negra.

R: Esto suele suceder si estás usando el dtype de VAE incorrecto. Asegúrate de que tu VAE esté configurado en bfloat16 si tu GPU lo admite, o float32 si estás en tarjetas más antiguas.

P: La configuración de 720p de LTX-2 bloquea mi PC.

R: Habilita --lowvram en tu archivo bat de ComfyUI. Además, asegúrate de que tu "conteo de fotogramas" siga la fórmula (8 * n) + 1 (por ejemplo, 97, 121) para una alineación óptima del tensor.

P: ¿Puedo usar esto comercialmente? R: ¡Sí! Si tus ingresos anuales son inferiores a $10 millones de dólares, la Licencia Comunitaria de LTX-2 permite el uso comercial completo.

Conclusión

Lightricks LTX-2 es un momento crucial para la IA de código abierto. Es la primera vez que tenemos un modelo que combina velocidad, audio y accesibilidad en un solo paquete.

Si bien puede que no supere a Wan 2.1 en coherencia bruta perfecta píxel a píxel, la capacidad de generar clips audiovisuales sincronizados es revolucionaria. Para la mayoría de los creadores, LTX-2 es la herramienta que finalmente trae sonido a la fiesta de video de IA.

Reseña de Seedance 1.5 Pro: La obra maestra audiovisual de ByteDance con Lip-Sync perfecto

Mientras LTX-2 abrió la puerta, Seedance 1.5 Pro la perfecciona. Experimenta la generación audiovisual nativa, el lip-sync preciso y el control de cámara complejo online.

Veo 4 vs Seedance 2.1: por qué la próxima guerra del video con IA puede girar más en torno al costo que al look cinematográfico

Seedance 2.1, Veo 4 y Gemini Omni Flash apuntan a un cambio clave: en video con IA cada vez importa más el costo de lograr clips estables y utilizables.

Seedance 2.1 podría llegar pronto: mejora reportada del 20%, tier más barato y qué deberían vigilar los creadores

Seedance 2.1 estaría cerca del lanzamiento, con una mejora reportada del 20% y un tier más barato de Seedance 2.0. Esto es lo conocido y lo no confirmado.

Kling 3.0 Stadium Fan Cam: gu铆a de prompts para un look de transmisi贸n real

C贸mo crear el Kling 3.0 stadium fan cam: checklist de broadcast realism, prompt base, fixes y un placeholder de comparaci贸n entre modelos.

Gemini Omni model: que es (y como construir seguro mientras todo sigue poco claro)

Guia practica sobre Gemini Omni model: separa rumor de contrato, usa Veo 3.1 hoy y prepara un router para habilitar Gemini Omni API cuando sea real.

Kling 3 4K cost routing: Ultra vs Pro vs Standard (cuando pagar por 4K)

Guia practica de Kling 3 4K cost: explora en 1080p, sube a 4K/Ultra solo al entregar y evita desperdiciar creditos en multi-shot.

Kling 3 4k Multishot Consistency

SEO-friendly description for search engines

Kling 3 I2v 4k Vs T2v 4k

SEO-friendly description for search engines